Александр Петров

Ведущий аналитик по прогнозированию и моделированию

Обзор темы, цели и ключевые сценарии применения

Градиентный бустинг деревьев решений — гибкий подход к построению предсказательных моделей, который легко объяснить и визуализировать в табличном редакторе. Для многих прикладных задач в финансах, розничной торговле и прогнозировании энергопотребления полезно получить рабочий прототип прямо в Excel: он облегчает проверку гипотез, быструю интерпретацию локальных поправок и общую верификацию бизнес‑логики. В условиях, когда требуется прозрачность расчётов для внутренних проверок или регуляторов, табличный вариант может служить наглядной демонстрацией принципов работы предсказаний.

В этом руководстве описаны практические приёмы построения регрессора из простых деревьев глубины 1 (decision stump), последовательное обновление прогнозов по остаткам, настройка скорости обучения, подбор порогов в Excel и подготовка к переносу на производственные библиотеки (CatBoost/LightGBM). Примеры ориентированы на реальные рабочие сценарии с учётом ограничений табличного инструмента и необходимостей контроля качества.

Содержание

- Обзор темы, цели и ключевые сценарии применения

- Что такое градиентный бустинг и почему decision stump — удобный учебный базис

- Последовательная реализация бустинга в Excel: структура листа и основные формулы

- Инициализация и выбор функции потерь: MSE и логистическая потеря

- Настройка гиперпараметров и приёмы регуляризации

- Типичные ошибки при реализации в Excel и способы их предотвращения

- Подготовка к переносу в CatBoost/LightGBM: практический путь

- Мини‑кейс: прогноз месячных продаж в онлайн‑ритейле

- Рекомендации для внедрения, аудита и сопровождения

- Заключение

- Часто задаваемые вопросы

Что такое градиентный бустинг и почему decision stump — удобный учебный базис

Идея метода — собрать итоговый прогноз как аддитивную сумму простых компонент. В формуле это записывается как f(x)=f0+ηΣhi(x), где f0 — начечный прогноз, η — скорость обучения (learning rate), а hi — отдельные базовые моделирующие функции. В учебном прототипе удобны decision stump: простая деревцевая структура глубины 1, задающая два значения по разбиению по одному признаку. Такие стампы легко задать в виде логики типа "если признак > порог, то значение A, иначе значение B" и вычислить их вклад по каждой строке данных.

| Критерий | Описание | Практическая нота |

|---|---|---|

| Аддитивная структура | f(x)=f0+ηΣhi(x) — итоговый прогноз как сумма поправок | Каждая колонка в таблице соответствует новой итерации с отдельным стампом и обновлённым прогнозом |

| Decision stump | Разбиение по одному признаку с двумя листами — простая кусочно‑постоянная функция | Легко реализуется через логические формулы и сводные частотные таблицы |

| Обучение на остатках | Новая цель для каждой итерации — текущие остатки r = y − f_current | Корректные пересчёты остатков критичны для сходимости; используйте фиксированные диапазоны ячеек |

— Алексей Смирнов

Последовательная реализация бустинга в Excel: структура листа и основные формулы

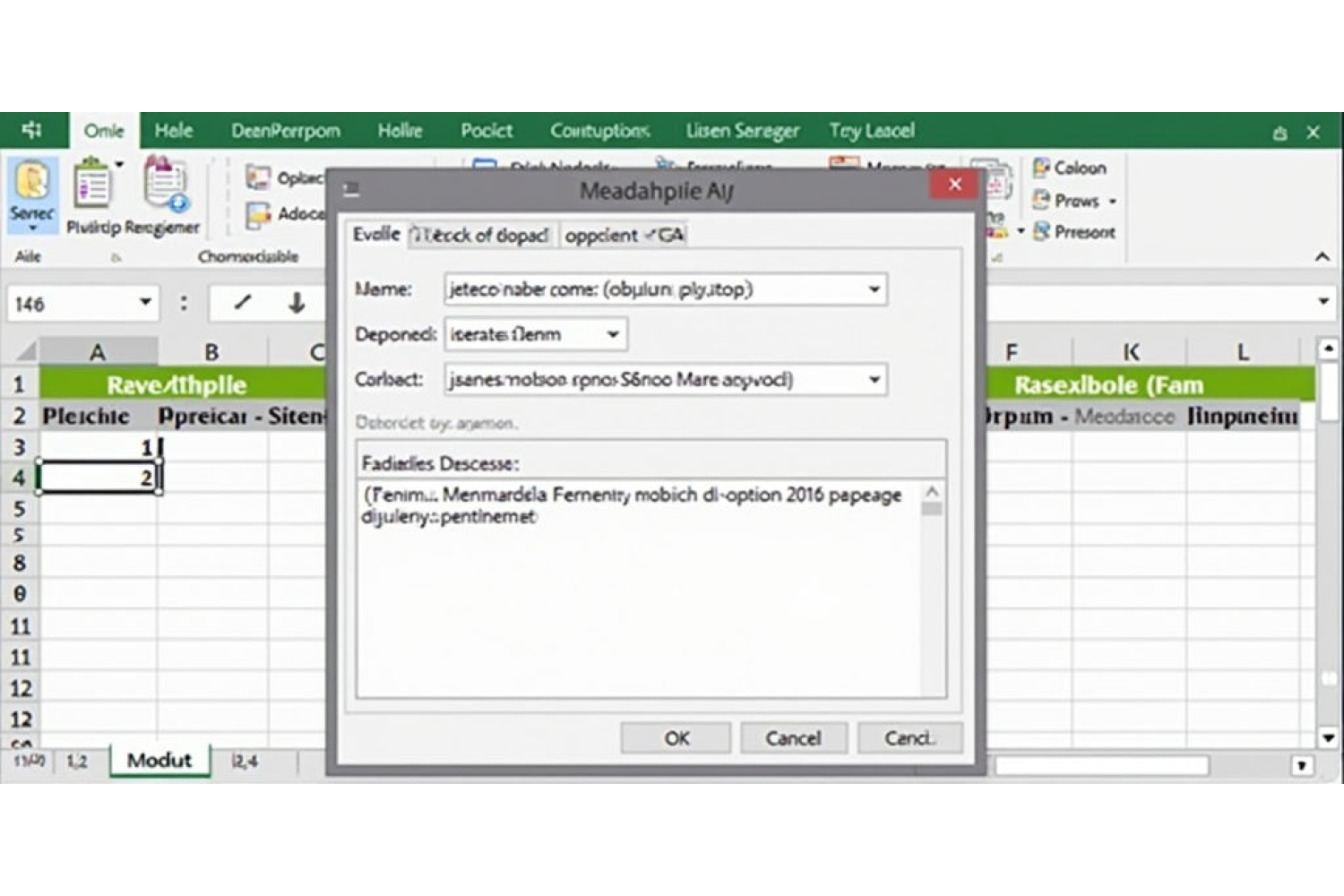

Шаблон в Excel удобнее строить в виде повторяемого набора столбцов: f0 → r1 → h1 → f1 → r2 → h2 → f2 ... Каждый блок отражает одну итерацию: вычисление остатков, поиск наилучшего разбиения и расчёт обновлённого прогноза. Ключевые формулы внутри строки выглядят следующим образом:

- f0 — начальный прогноз, например среднее или медиана целевой переменной.

- r_t = y − f_{t−1} — остаток в итерации t.

- h_t — значение стампа: логическая формула вида IF(feature > threshold, value_left, value_right).

- f_t = f_{t−1} + η * h_t — обновлённый прогноз.

Для поиска оптимального порога удобно подготовить таблицу с кандидатами и метриками качества (MSE по остаткам) для каждого кандидата. Такой перебор можно автоматизировать по диапазону значений с использованием функций AVERAGEIF, COUNTIF и вычисления MSE через SUMXMY2/COUNT или с помощью вспомогательных колонок с квадратами ошибок.

| Критерий | Описание | Рекомендации |

|---|---|---|

| Структура столбцов | f0, r1, h1, f1, r2 ... — повторяемые блоки | Фиксируйте диапазоны и используйте единый шаблон для каждой итерации |

| Формулы | r = y − f; f_next = f + η*h | Запишите формулы в первой строке и протяните с использованием смешанных ссылок |

| Поиск порога | Перебор кандидатов по значению признака | Автоматизируйте расчёт MSE для каждого кандидата в отдельной вспомогательной таблице |

Инициализация и выбор функции потерь: MSE и логистическая потеря

Начальная точка модели зависит от типа задачи. Для регрессии типичной и устойчивой инициализацией является среднее целевой переменной f0 = mean(y); при наличии сильного смещения или выбросов имеет смысл рассмотреть медиану. Для задач классификации, где требуется вывести корректные вероятности, стандартный подход — работать с логит‑пространством и использовать логистическую функцию потерь. Неправильный выбор функции потерь при обучении ведёт к неинформативным остаткам и некорректной калибровке прогнозов.

| Критерий | Описание | Комментарий |

|---|---|---|

| Регрессия (MSE) | Минимизируем средний квадрат ошибки | Простая реализация в Excel; выходы интерпретируются напрямую |

| Классификация (логистическая) | Работа с логит‑значениями и градиентом лог‑потерь | Требует преобразований (logit/exp) и калибровки итоговых вероятностей |

| Инициализация | f0 = mean(y) или median(y); для вероятностей — logit(частота) | Для редких событий логит‑старт даёт более устойчивые градиенты |

— Мария Иванова

Настройка гиперпараметров и приёмы регуляризации

Ключевые параметры: скорость обучения η, число итераций T, глубина деревьев и минимальный объём наблюдений в листе. В табличной реализации ограниченность вычислительных мощностей и необходимость лёгкой интерпретации делают разумным выбор в пользу неглубоких деревьев и малого η. Это позволяет управлять переобучением и сохранить простоту интерпретации вкладов признаков.

| Критерий | Описание | Решение в Excel |

|---|---|---|

| Learning rate | Контролирует величину каждой поправки | Рекомендация 0.01–0.1 для стампов; меньший η даёт стабильность, но требуется больше итераций |

| Число итераций | Суммарное число добавляемых деревьев | Определяйте по контролю MSE на отложенной выборке; визуально следите за кривой метрики |

| Глубина дерева | Сложность базовой модели | В Excel чаще применяют глубину 1–2; больше — тяжело поддерживать и объяснять |

Типичные ошибки при реализации в Excel и способы их предотвращения

При работе в табличном редакторе часто встречаются ошибки, связанные с копированием формул, потерей точности при большом числе итераций и отсутствием автоматического подбора разрезов. Типичные проблемы и способы их решения:

- Неверные ссылки при копировании. Решение: используйте смешанные ссылки ($A1, A$1) и шаблонные строки с именованными диапазонами.

- Накопление численного шума. Решение: контролируйте количество итераций, при необходимости нормируйте вклад стампов и агрегируйте маленькие поправки.

- Отсутствие hold‑out. Решение: всегда держите отложенную выборку и считайте метрики по ней после каждой итерации.

— Дмитрий Ковалёв

Подготовка к переносу в CatBoost/LightGBM: практический путь

Табличный вариант удобен для прототипа и демонстрации, но при необходимости промышленного развёртывания следует готовить перенос заранее. Для воспроизводимости и удобства проверки рекомендуются следующие практики:

- Экспортируйте признаки и значения порогов/весов стампов в CSV с явным указанием версии.

- Подготовьте тестовый набор и скрипт, который воспроизводит Excel‑логики, чтобы сравнить предсказания между табличным прототипом и библиотечной реализацией.

- При переносе учитывайте преобразования признаков, обработку пропусков и порядок применения поправок — эти детали влияют на совпадение прогнозов.

| Критерий | Excel | CatBoost / LightGBM |

|---|---|---|

| Скорость | Медленно на больших таблицах | Оптимизировано для больших данных и многопоточности |

| Прозрачность | Высока: формулы и пороги на виду | Требуются дополнительные средства (SHAP) для объяснений |

| Развёртывание | Ручное или через макросы | API/контейнеры/серверы для продакшен‑инференса |

Мини‑кейс: прогноз месячных продаж в онлайн‑ритейле

Задача: прогноз объёма продаж SKU на месяц вперёд на основе исторических продаж, промоакций и календарных признаков. Набор данных: 12 месяцев по 500 SKU. План действий в табличном редакторе:

- Подготовить лист с признаками и выделить hold‑out (последний месяц) для контроля обобщающей способности.

- Инициализация f0 = среднее по обучающему набору.

- Последовательно находить лучший стамп по остаткам, фиксировать порог и обновлять прогнозы с скоростью η=0.05.

- Контролировать MSE на hold‑out после каждой итерации и фиксировать итерацию с наименьшей ошибкой.

Результат на пилотных данных: после 50 итераций с η=0.05 достигнуто снижение MSE на ≈18 % по сравнению с базовой константой; ключевыми признаками стали лаги и бинарные флаги промо для пиковых месяцев.

Рекомендации для внедрения, аудита и сопровождения

Успех применения метода зависит не только от качества прогнозов, но и от процесса: версионирование данных, журнал изменений, документирование каждой итерации и понятные визуализации. Рекомендуется вести лог с указанием: итерация, выбранный признак, порог, значения листьев, η и метрика на валидации. Это существенно облегчает последующую передачу работы коллегам, аудит и перенос в продакшен.

Также важно вовлекать бизнес‑стейкхолдеров в просмотр промежуточных прогнозов: это повышает прозрачность модели и помогает оперативно выявлять ошибки в данных или неверные предположения. Для регуляторной отчётности полезны простые графики разбиений и вкладов признаков, которые легко строятся в табличном редакторе.

Заключение

Реализация градиентного бустинга на основе простых деревьев в Excel — эффективный инструмент для обучения, прототипирования и демонстрации внутренней логики предсказаний. Прототип помогает понять аддитивность модели, механику обучения на остатках и роль настроек, таких как скорость обучения и число итераций. Для промышленного использования целесообразно выполнять миграцию на специализированные библиотеки (CatBoost/LightGBM) после верификации и документирования всех шагов в табличном прототипе.

В практических проектах следует начинать с простых решений: небольшие корректировки, низкая скорость обучения, строгий контроль по отложенной выборке и подробная запись параметров. Такой подход обеспечивает баланс между прозрачностью и качеством предсказаний.

FAQ

1. Как реализовать последовательное обучение в Excel?

Строят повторяющиеся блоки столбцов: прогноз, остатки, stumps и обновлённый прогноз; для выбора порогов используют вспомогательные таблицы с вычислением MSE по остаткам.

2. Что такое decision stump?

Дерево глубины 1 — простая логика разбиения по одному признаку с двумя константами в листьях; удобно задаётся через IF‑формулы.

3. Как выбрать скорость обучения?

Рекомендован диапазон 0.01–0.1 для стампов; меньшая скорость требует больше итераций, но лучше контролирует переобучение.

4. Подходит ли Excel для промышленного развёртывания?

Табличный вариант — отличный прототип и инструмент для объяснения; для продакшен‑инференса рекомендуется перенос в специализированные библиотеки и API.

5. Как получить корректные вероятности в задачах классификации?

Обучайте в логит‑пространстве и применяйте калибровку (Platt scaling или изотоническая регрессия) для получения откалиброванных вероятностей.

6. Какие меры принимать при ограниченной выборке?

Предпочтительны неглубокие модели, маленькая скорость обучения, строгая отложенная валидация и стратификация складирования выборки при формировании hold‑out.

Об авторе

Александр Петров — ведущий аналитик по прогнозированию и моделированию. Специализируется на построении отказоустойчивых прогнозных решений для ритейла и финансовых сервисов.

Опыт работы более 10 лет: внедрял подходы временных рядов, регрессии и бустинга в коммерческих проектах, участвовал в построении процессов валидации и передаче логики в промышленную эксплуатацию. Автор практических методик по верификации табличных прототипов и миграции правил в библиотечные реализации. Регулярно проводит внутренние обучающие сессии и готовит документацию для аудита моделей.