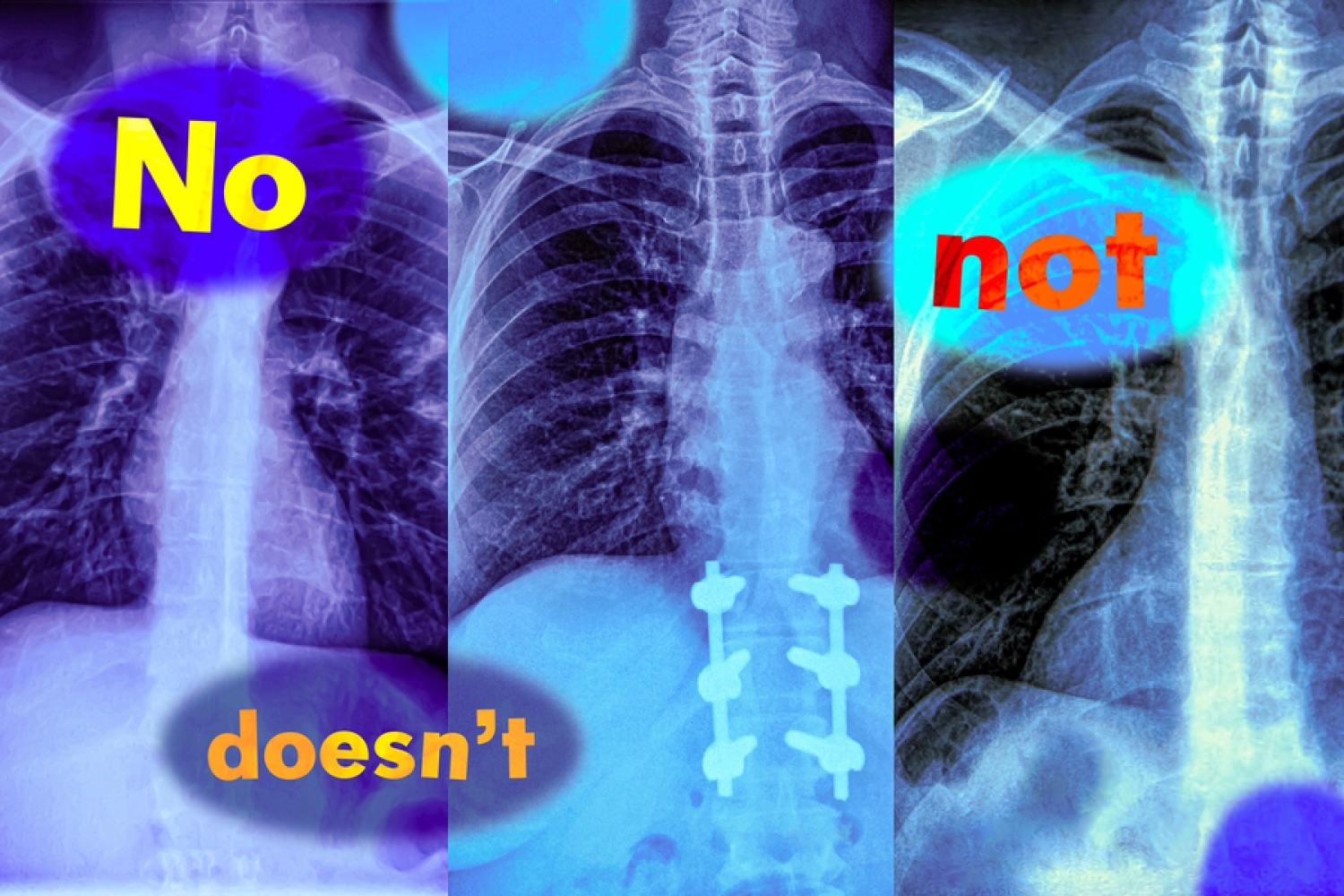

Новое исследование выявило, что современные модели, объединяющие обработку изображения и текста, плохо понимают отрицательные конструкции в запросах, что ограничивает их эффективность.

Ученые провели исследование работы современных vision-language моделей, которые сочетают анализ изображений и текста, и выяснили, что они слабо справляются с обработкой отрицаний в запросах. Так, при использовании слов с отрицательным смыслом, например «не», «без» или «ни», модели часто дают неверные или неполные ответы.

Авторы исследования отметили, что это связано с ограничениями в архитектуре моделей и алгоритмах обучения, которые недостаточно учитывают сложные лингвистические конструкции. По словам экспертов, это влияет на качество систем в реальных приложениях, где важно правильно интерпретировать отрицания, например, при поиске по изображениям или в диалоговых системах.

Один из ведущих исследователей подчеркнул: «Понимание отрицаний — ключевой элемент человеческого языка, и отсутствие этого навыка у моделей ставит под сомнение их способность полноценно взаимодействовать с пользователями». В будущем разработчики планируют улучшить обучение моделей, добавляя больше примеров с отрицаниями и разрабатывая новые архитектурные решения.

Эксперты прогнозируют, что совершенствование обработки отрицаний существенно повысит качество систем искусственного интеллекта, что особенно важно для медицины, образования и других областей, где требуется точное понимание запросов и данных.