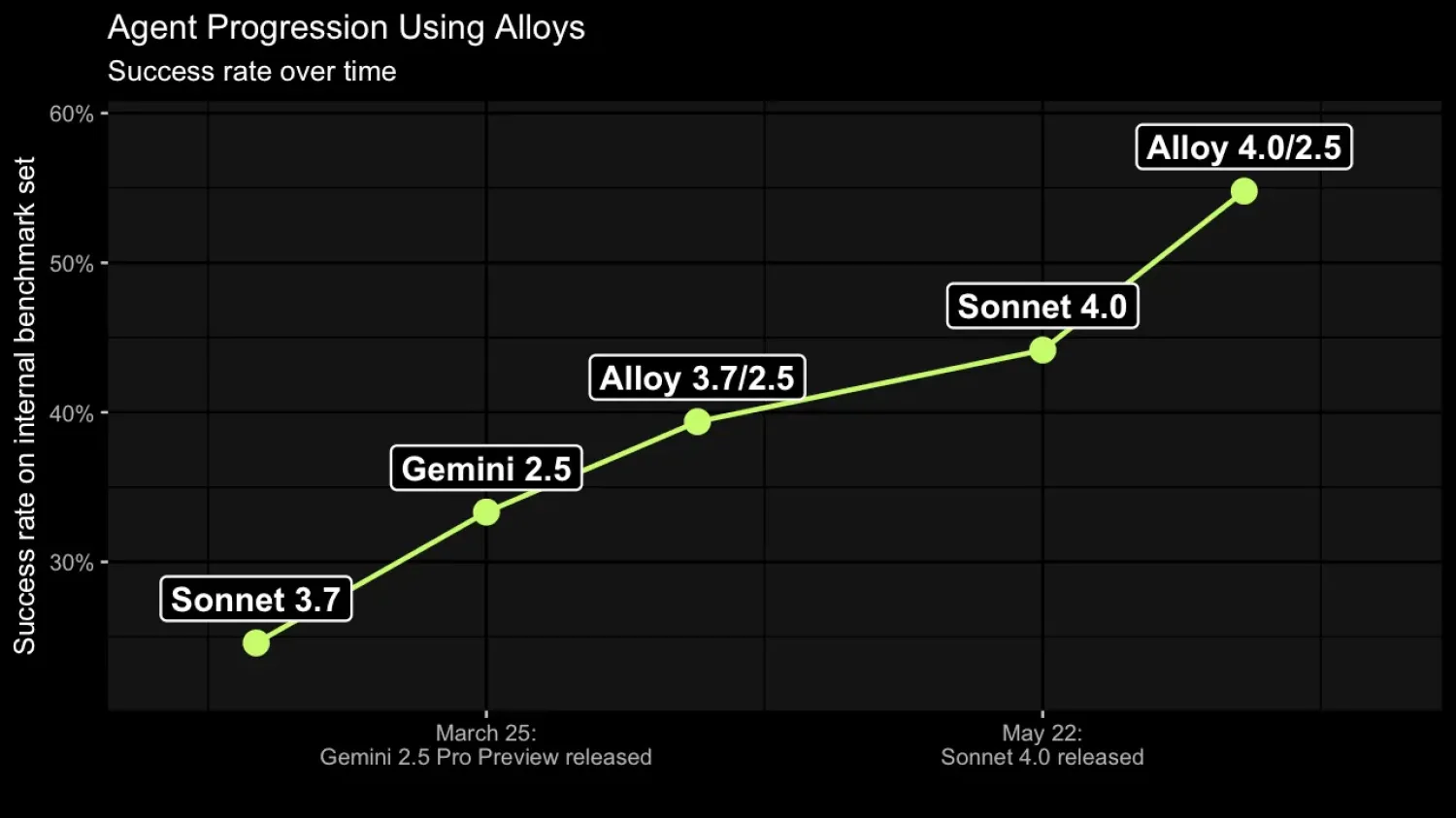

Честно говоря, весной в XBOW придумали трюк, который вывел их автономных «пентестеров» на новый уровень. Используя так называемые модельные сплавы агентов, команда смогла поднять успех обнаружения уязвимостей с 25% до впечатляющих 55%.

Вызов XBOW

XBOW — это автономный сканер безопасности: вы указываете на сайт, и он пытается «взломать» его без подсказок извне. Типично агенту нужно составить модель приложения, пробовать разные подходы и анализировать результаты. Но когда речь заходит о сотнях похожих задач, нужен чёткий механизм, который не сбивается с линии.

Что такое модельные сплавы агентов?

Представьте, что вы смешиваете два металла и получаете новый, прочнее каждого из компонентов. Здесь идея похожая: вместо одной LLM-«головы» для каждой итерации берутся две (или более) модели — например, Sonnet и Gemini. Они по очереди предлагают шаги, не подозревая о существовании «коллеги», но вместе создают более сбалансированное решение.

Принцип работы

На каждом шаге мы выбираем модель случайно (можно и по схеме). Одна делает команду, вторая продолжает диалог в том же чате. Когда та, что обычно выдаёт смелые идеи, чередуется с «рабочей лошадкой» для уточнений и верификации, процесс идёт быстрее и точнее.

Результаты

Как в сплаве металлов, сочетание разных LLM дало синергетический эффект: пары моделей показывали лучшую среднюю точность, чем каждая по отдельности. Чем сильнее различаются модели, тем выше рост — до трех моделей в «сплаве» эффективность продолжает расти.

Когда стоит попробовать

Модельные сплавы полезны, если:

- Задача требует множества креативных идей;

- Вы запускаете итеративный цикл с десятками запросов;

- У вас есть доступ к разным LLM с разными сильными сторонами.

Когда лучше воздержаться

Но сплав не всегда помогает. Если ваша задача линеен и каждый шаг ведёт к цели, или одна модель справляется сама, — дополнительная сложность не окупит себя. А ещё учтите: хранить кэши придётся для каждого участника сплава.