Исследователи EPFL представили MEMOIR — новую масштабируемую систему для редактирования знаний в больших языковых моделях (LLM), способную эффективно обновлять информацию без потери старых данных.

Большие языковые модели демонстрируют выдающиеся результаты, однако быстро устаревают и могут выдавать неточные или искажённые ответы. Классические методы дообучения требуют значительных ресурсов и часто приводят к «катастрофическому забыванию» — потере ранее усвоенных знаний. MEMOIR решает эту проблему, позволяя вносить изменения локально и надёжно, без ущерба для общей работы модели.

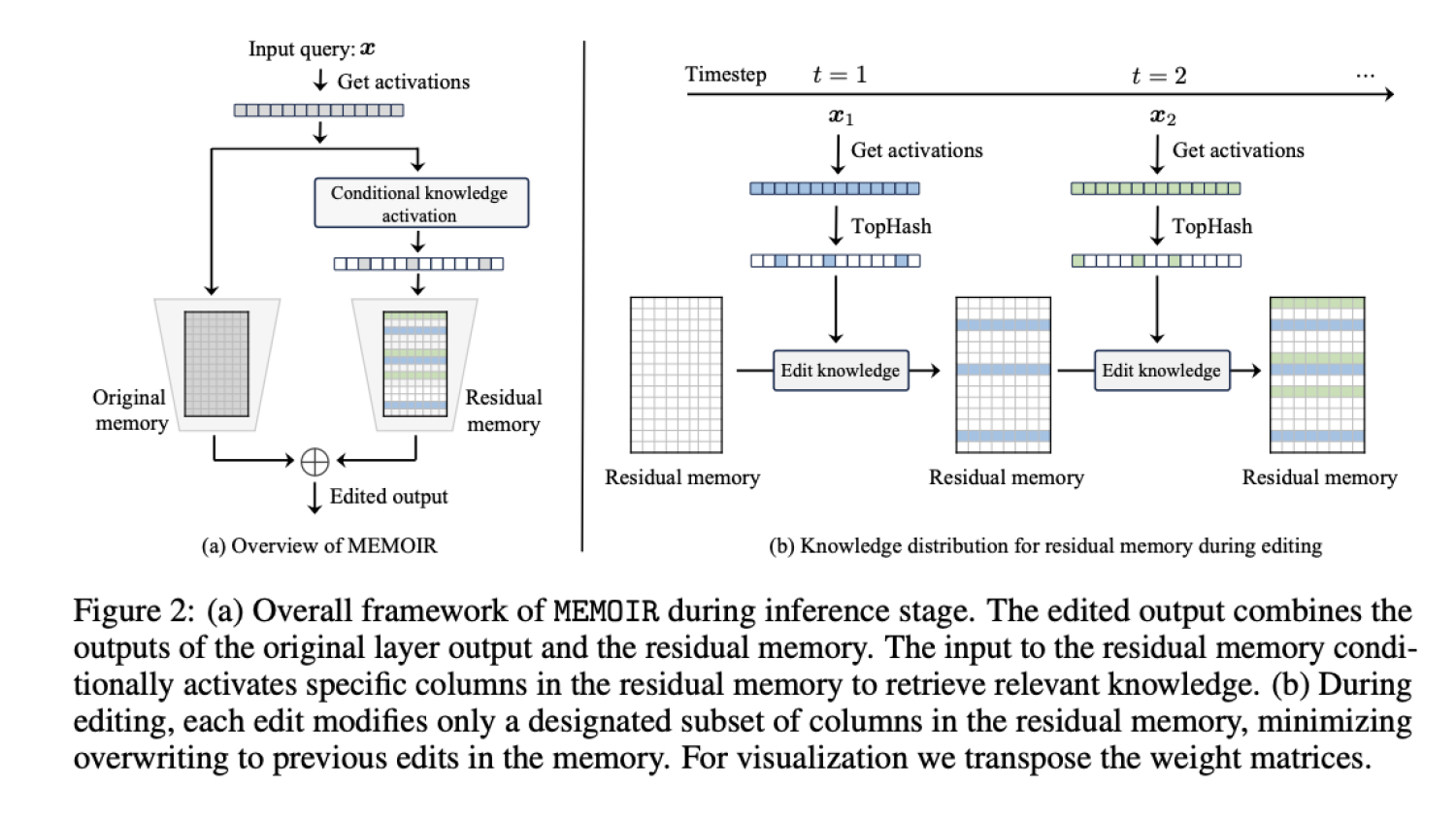

«MEMOIR использует специальный модуль памяти, который выделяет отдельные подмножества параметров для каждого редактирования и активирует их только по соответствующим запросам», — отмечают разработчики. Такой подход минимизирует перезапись старых знаний и снижает риск забывания, а структурная разреженность позволяет активировать только те параметры, которые нужны для конкретного запроса.

В ходе экспериментов на популярных моделях LLaMA-3, Mistral и GPT-J MEMOIR показал превосходство над существующими решениями (ROME, WISE, GRACE) по точности, сохранению знаний и устойчивости к большому количеству правок. Например, на датасете ZsRE MEMOIR достиг средней метрики 0,95 при 1000 изменениях, что на 0,16 выше ближайшего конкурента. Кроме того, система сохраняет высокую локальность и низкую перплексию даже при сотнях последовательных правок.

Разработчики отмечают, что пока MEMOIR ограничен редактированием только одного слоя, однако в будущем планируется расширение на многослойные архитектуры и применение в мультимодальных и энкодер-декодерных моделях.

Эксперты считают, что появление подобных систем открывает путь к созданию по-настоящему самообновляемых и надёжных языковых ИИ, способных быстро адаптироваться к новым данным без потери предыдущих знаний.