Искусственный интеллект VLM-R³ вышел на новый уровень визуально-языкового анализа

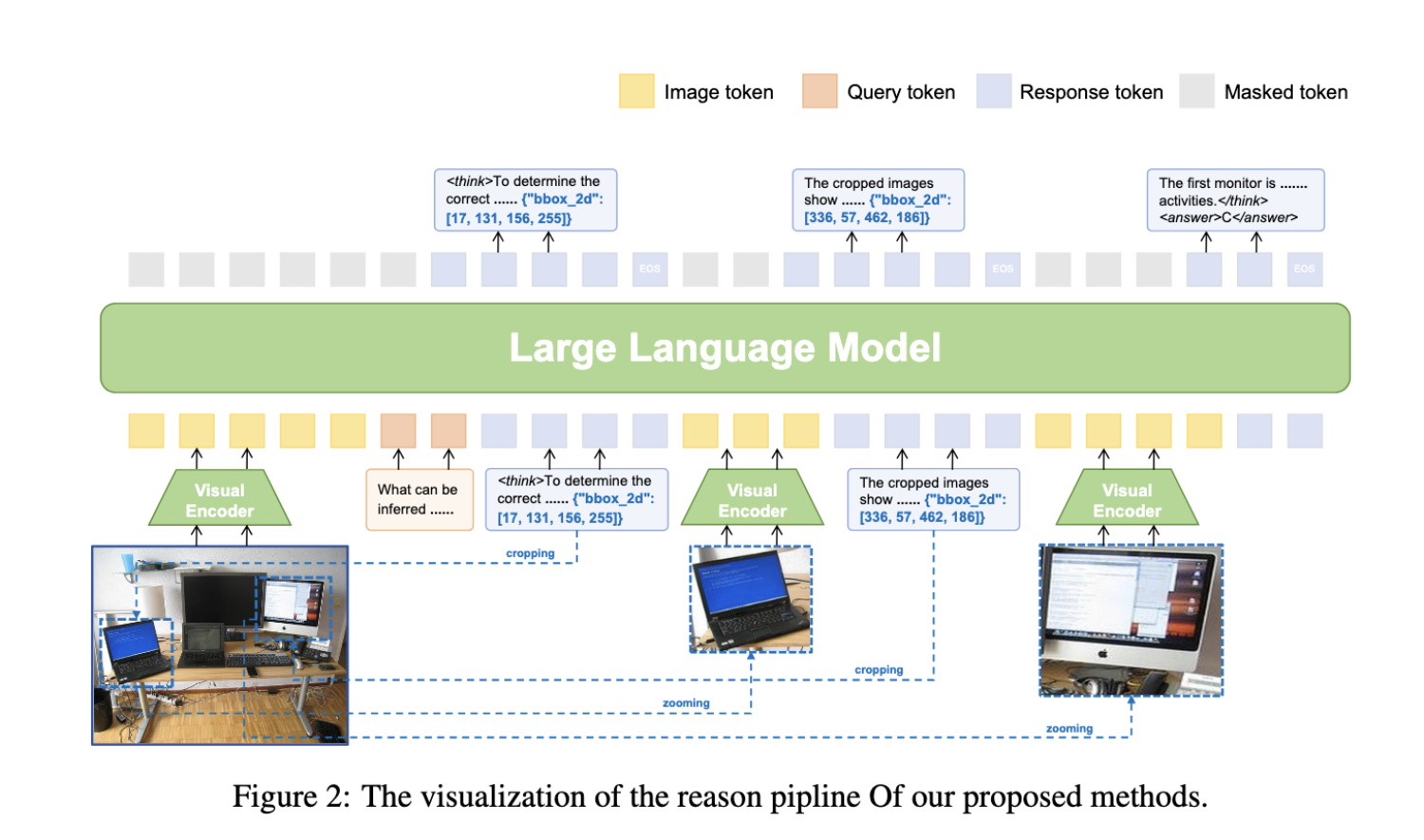

Новая архитектура VLM-R³ предлагает инновационный подход к решению задач мультимодального взаимодействия между изображениями и текстом. Она объединяет три ключевых компонента: распознавание регионов, логическое рассуждение и уточнение информации.

Разработанная модель фокусируется на высокоточном определении объектов и их взаимосвязей в рамках визуальной сцены, опираясь на текстовые подсказки. Авторы исследования утверждают, что подход VLM-R³ позволяет улучшить интерпретацию сложных визуальных сцен, где традиционные модели сталкиваются с ограничениями.

«Мы стремились к системе, способной не только идентифицировать объекты, но и делать логические выводы на основе их контекста и уточнять своё понимание в процессе анализа», — подчёркивают разработчики.

VLM-R³ использует специальные модульные блоки: Region Recognizer для анализа ключевых областей на изображении, Reasoning Engine для интерпретации отношений между ними и Refinement Module для дополнительной настройки и повышения точности. Этот подход обеспечивает более глубокое понимание визуального контекста в задачах визуального ответа на вопросы (VQA), референциального выражения и других визуально-языковых задач.

По мнению экспертов, архитектура VLM-R³ открывает перспективы для создания более «осмысленных» систем ИИ, способных эффективно работать в условиях неоднозначной визуальной информации. Предполагается, что такие системы найдут применение в медицинской диагностике, интеллектуальных помощниках, системах наблюдения и образовании.

Разработка подчеркивает продолжающийся тренд на усложнение и «очеловечивание» алгоритмов машинного зрения, стремящихся к более гибкому и контекстно-зависимому восприятию мира.