Голосовые ИИ-агенты становятся все более востребованными благодаря своей способности вести естественный диалог и выполнять широкий спектр задач. Эксперты AWS отмечают, что сочетание открытого фреймворка Pipecat и моделей Amazon Bedrock позволяет быстро создавать и внедрять такие решения в бизнес-процессы и сервисы.

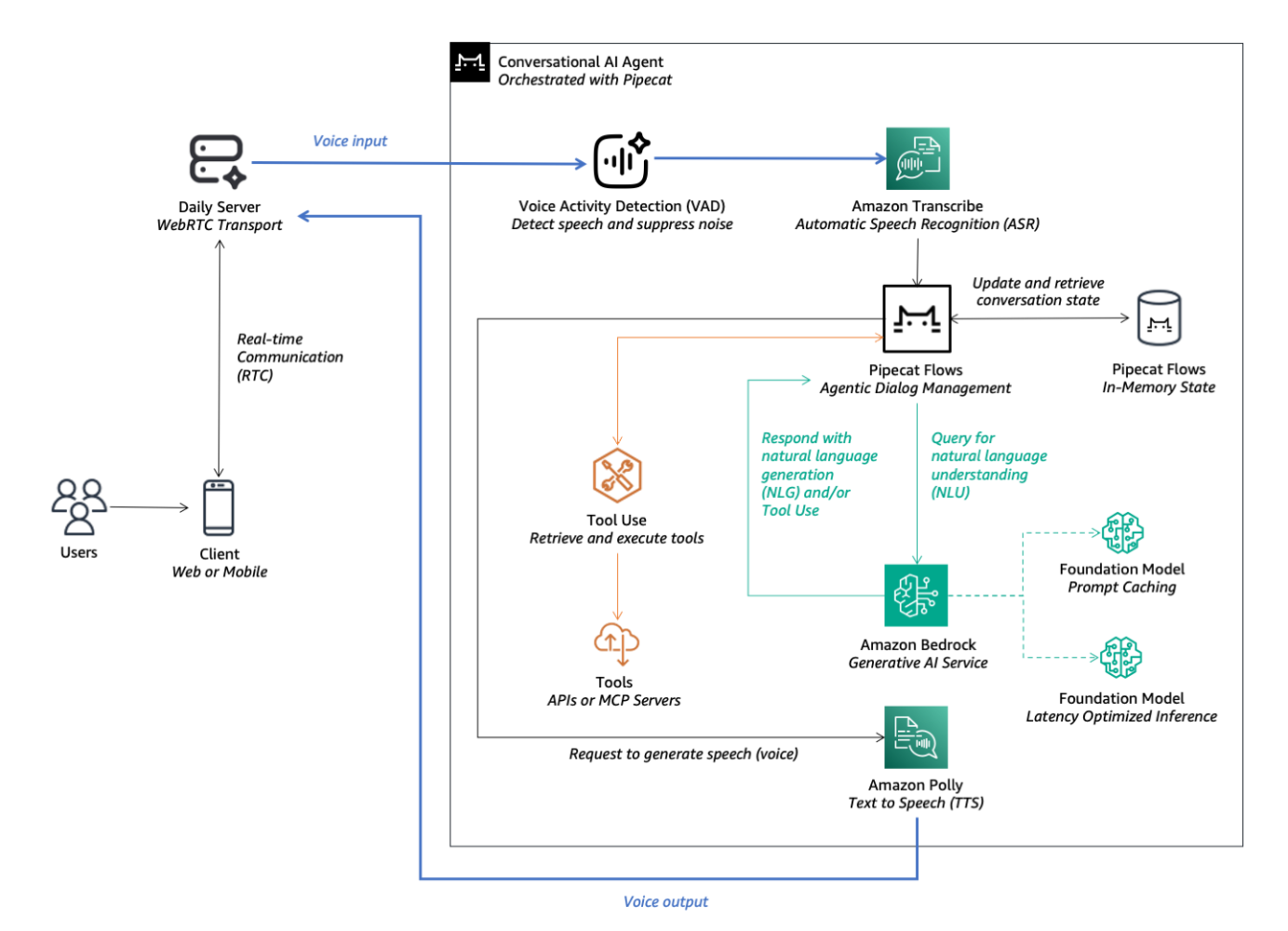

В первой части руководства AWS рассматривается так называемый каскадный подход, при котором голосовой ввод пользователя проходит через последовательность специализированных компонентов: от обнаружения активности речи и автоматического распознавания (ASR) до понимания естественного языка (NLU) и генерации ответов (NLG). Для синтеза речи используется Amazon Polly с поддержкой генеративных голосов, а оркестрация всех процессов осуществляется модульным Python-фреймворком Pipecat.

В числе ключевых практик по созданию эффективных ИИ-агентов специалисты AWS выделяют минимизацию задержек, выбор оптимальных моделей, кэширование запросов и внедрение естественных фраз-заполнителей для поддержания вовлечённости пользователя. "Начните с простых сценариев и постепенно усложняйте логику агента", — советуют авторы.

В качестве примера приводится готовое приложение, которое можно развернуть за считанные минуты с помощью Pipecat, Amazon Bedrock и WebRTC. Для запуска потребуется Python 3.10+, аккаунт AWS с нужными правами и современный браузер. После настройки серверной части и подключения микрофона пользователь может начать диалог с ИИ-агентом прямо в браузере.

Эксперты прогнозируют, что развитие голосовых ИИ-агентов приведёт к появлению новых сервисов в сферах поддержки клиентов, автоматизации звонков и персональных помощников. Представители финтех-компании InDebted отмечают, что такие технологии позволяют повысить качество обслуживания и эффективность контакт-центров.

В заключении AWS подчеркивает, что современные инструменты делают создание интеллектуальных голосовых агентов доступным для широкого круга разработчиков и компаний. Следующая часть руководства будет посвящена архитектуре на базе единой модели "речь-в-речь".