MemAgent: RL-фреймворк для безграничных контекстов в LLM

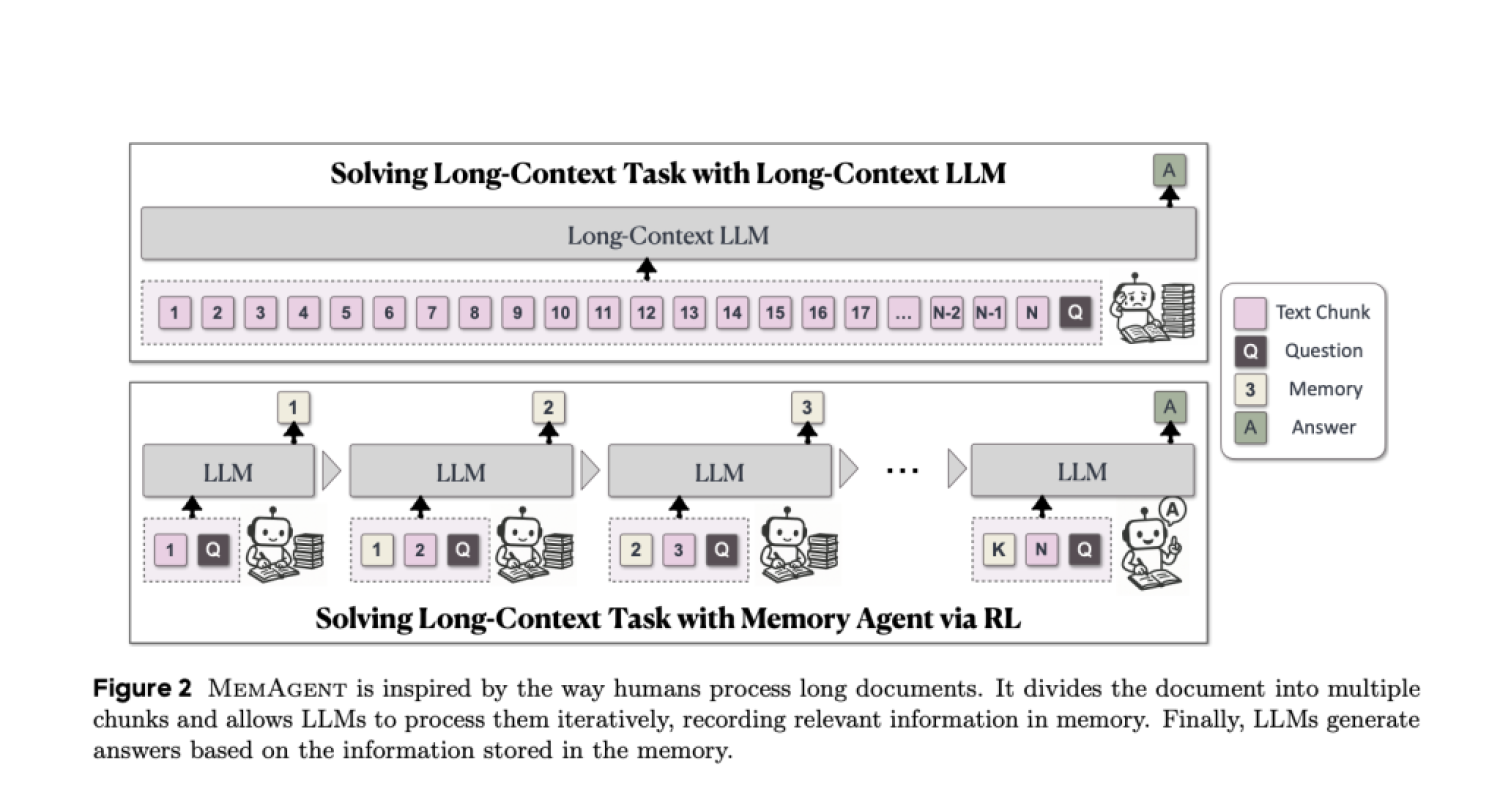

Представьте, что ваша языковая модель читает гигантские тексты как ленту новостей — без остановок, без тормозов. Новый фреймворк MemAgent на основе обучения с подкреплением переключается на потоковый режим: фиксированная память обрабатывает документ частями, а затем «перезаписывается», сохраняя лишь главное и забывая лишнее. Это даёт линейную сложность и масштабируемость до миллиона и более токенов без архитектурных переделок и внезапных провалов в качестве вывода.

Ключ к успеху — стратегия замены: модель читает фрагмент текста, обновляет память и движется дальше, как опытный журналист, который выделяет суть статьи и переходит к следующей теме, не перегружая разум деталями. Такой подход контрастирует с классическими методами — разреженным вниманием или удлинёнными позиционными эмбеддингами — где производительность часто падает на длинных контекстах.

MemAgent учат с помощью расширенной версии GRPO (Group Relative Policy Optimization) в многоразговорной среде DAPO. Правила-верификаторы оценивают, что важно сохранить, а что можно отбросить, — и агент постепенно учится фокусироваться на действительно нужных фрагментах текста.

В экспериментах на RULER и HotpotQA MemAgent обошёл такие сильные базовые модели, как Qwen2.5 и QwenLong-L1, демонстрируя высокую точность даже при 3,5 млн токенов. Результат? Практичное решение для глубокого анализа огромных документов и сложного повествования без задержек и просадок по качеству.

Готовы ли вы к эпохе безграничного контекста? Теперь это не фантастика, а реальность: MemAgent помогает LLM отвечать на вопросы по длиннейшим текстам с той же лёгкостью, с какой вы листаете социальные сети.