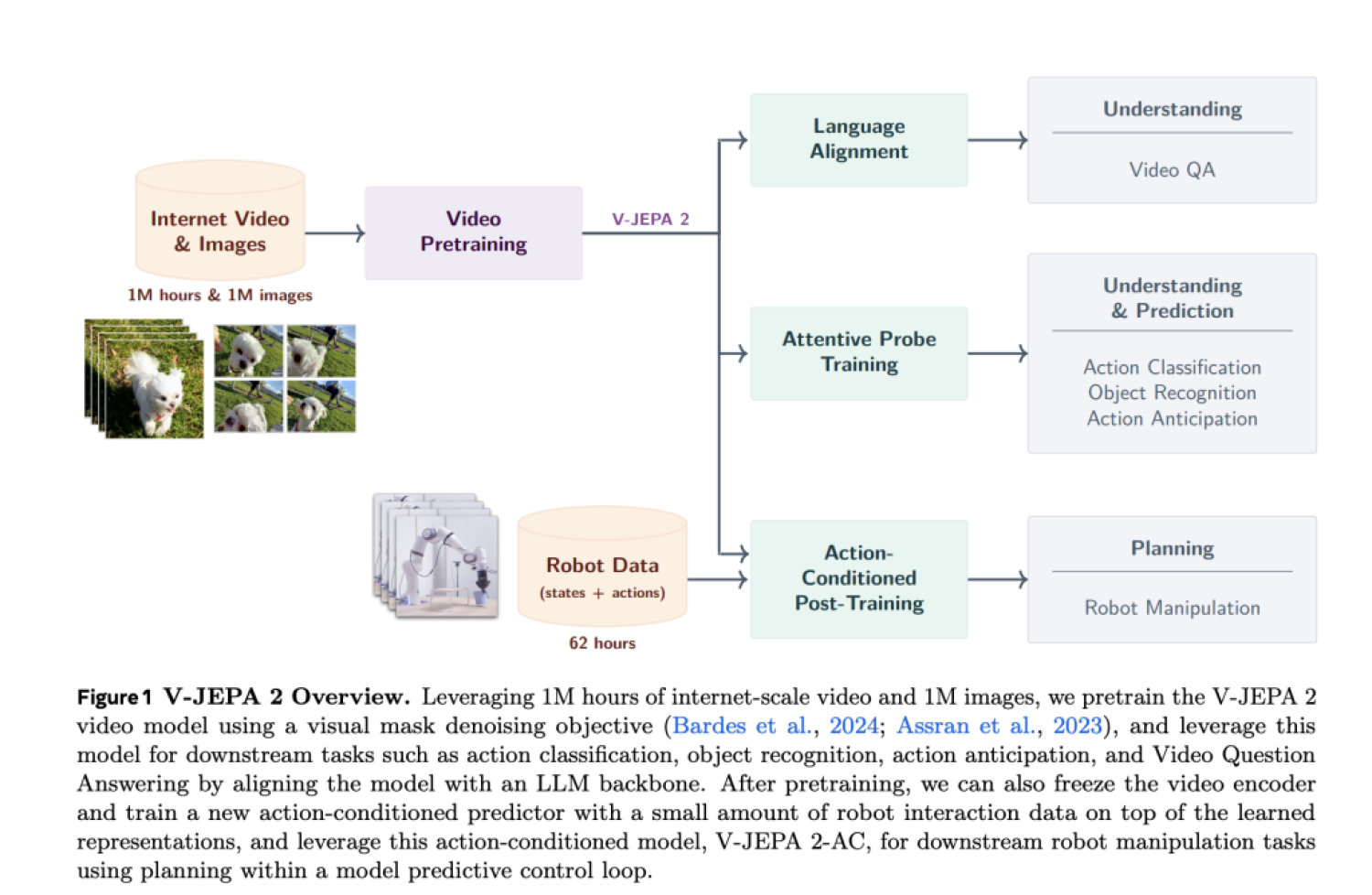

Meta AI представила V-JEPA 2 — продвинутую самообучающуюся модель, способную моделировать и предсказывать события в видеопотоках без необходимости ручной разметки данных.

Новое поколение модели V-JEPA (Video Joint Embedding Predictive Architecture) использует уникальный подход к обучению. Вместо обработки каждого кадра как отдельного изображения, модель обучается распознавать взаимосвязи между объектами и их действиями во времени. Это позволяет V-JEPA 2 "предсказывать будущее" и планировать поведение, основываясь на видеонаблюдении.

Разработчики подчеркивают, что V-JEPA 2 отличается от традиционных моделей компьютерного зрения, которые полагаются на аннотированные датасеты. Новая модель способна учиться на неразмеченных данных, используя механизмы самопредсказания. Это делает её более универсальной и применимой к реальным сценариям, где аннотированные данные труднодоступны или слишком дороги.

«Главная задача V-JEPA 2 — не просто видеть, а понимать», — отмечает команда Meta AI. Модель строит пространственно-временные представления, что позволяет ей улавливать сложные причинно-следственные связи и контекст в видеопотоке.

Кроме того, архитектура V-JEPA 2 может быть полезной в задачах, связанных с робототехникой, автономными системами и моделированием поведения агентов в виртуальных и физических средах. Исследователи уверены, что такой подход станет важным шагом на пути к созданию универсальных ИИ-систем с высоким уровнем адаптации к окружающей среде.

Meta AI открыла код модели и сопутствующие инструменты для сообщества разработчиков, что дает возможность интеграции и тестирования V-JEPA 2 в различных проектах и исследованиях.