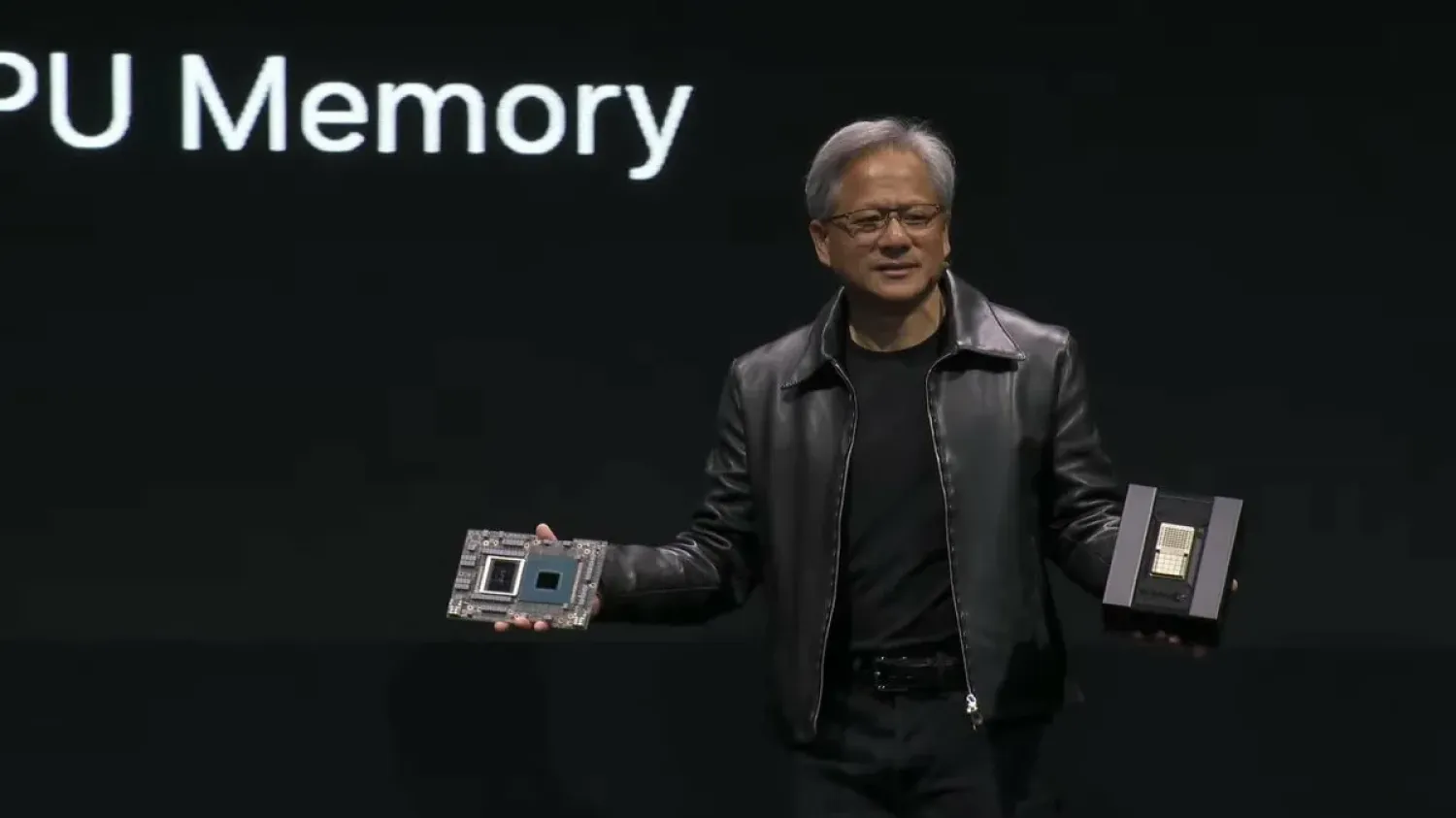

Новая версия XGBoost 3.0 открывает путь к обучению моделей на терабайтных данных — и да, теперь всё это умудряется уместиться на одном-единственном чипе Grace Hopper от NVIDIA. Представьте: раньше для подобных объёмов требовалась целая куча серверов, теперь достаточно одного суперчипа.

В основе — External-Memory Quantile DMatrix. Это звучит внушительно, но по сути — умный флажок, который позволяет стримить данные прямо из оперативки в графический чип, ломая прежние ограничения по памяти. Почему это круто? Потому что ваши «терабайты» не сидят складом в GPU, а подгружаются по-творчески, по ходу дела — быстро и без тормозов, как бы то ни звучало.

И вот где кайф: Grace Hopper суперчип оснащён связью NVLink-C2C с пропускной способностью 900 ГБ/с — во-первых, это примерно в семь раз быстрее, чем x16 PCIe 5.0, во-вторых, с минимальной задержкой. В сухом остатке: обучение на 1 ТБ идёт до 8× быстрее, чем на мощном CPU-кластере из 112-ядерного Xeon’а. Да-да, вы не ослышались — одному чипу справиться до 8 раз быстрее и проще.

Звучит как забота об удобстве? Именно. Устраняется головная боль подбора множества GPU, настройки распределённых фреймворков. Нет лишней суеты — просто запускаете, и XGBoost сам берёт на себя управление потоком данных. А точность, кстати, остаётся на прежнем уровне — никаких потерь при сжатии.

Удобно до невозможности. Финансовые системы, анти-фрод, скоринг — все те места, где требуется скорость и объяснимость (SHAP-анализ, помните?) — вдруг обретают суперсилу. Например, RBC говорит, что при переходе на GPU-ускорение они получили до 16× ускорения и сократили общую стоимость владения на 94 %. Это прям ах!

Конечно, такие технологии — не ради эффектного заголовка. Это реальные улучшения для инженеров и учёных, которые тянут годами выросшие датасеты. XGBoost 3.0 — это словно обновление в вашей IDE, которое не меняет привычный интерфейс, но ускоряет всё вокруг.

Вопрос: готовы ли вы попробовать «терабайтный» режим XGBoost у себя? Поделитесь, что думаете — я слушаю.