OpenBMB представила MiniCPM4 — ультраэффективные языковые модели нового поколения, оптимизированные для работы на устройствах с ограниченными ресурсами. Новинка обещает революцию в мобильном и встраиваемом ИИ благодаря высокой скорости и качеству обработки длинных текстов.

Команда OpenBMB анонсировала MiniCPM4 — семейство компактных языковых моделей, специально созданных для работы на устройствах с ограниченными вычислительными возможностями. В линейке представлены две версии: на 0,5 и 8 миллиардов параметров, что позволяет использовать их как в мобильных, так и в промышленных встраиваемых системах.

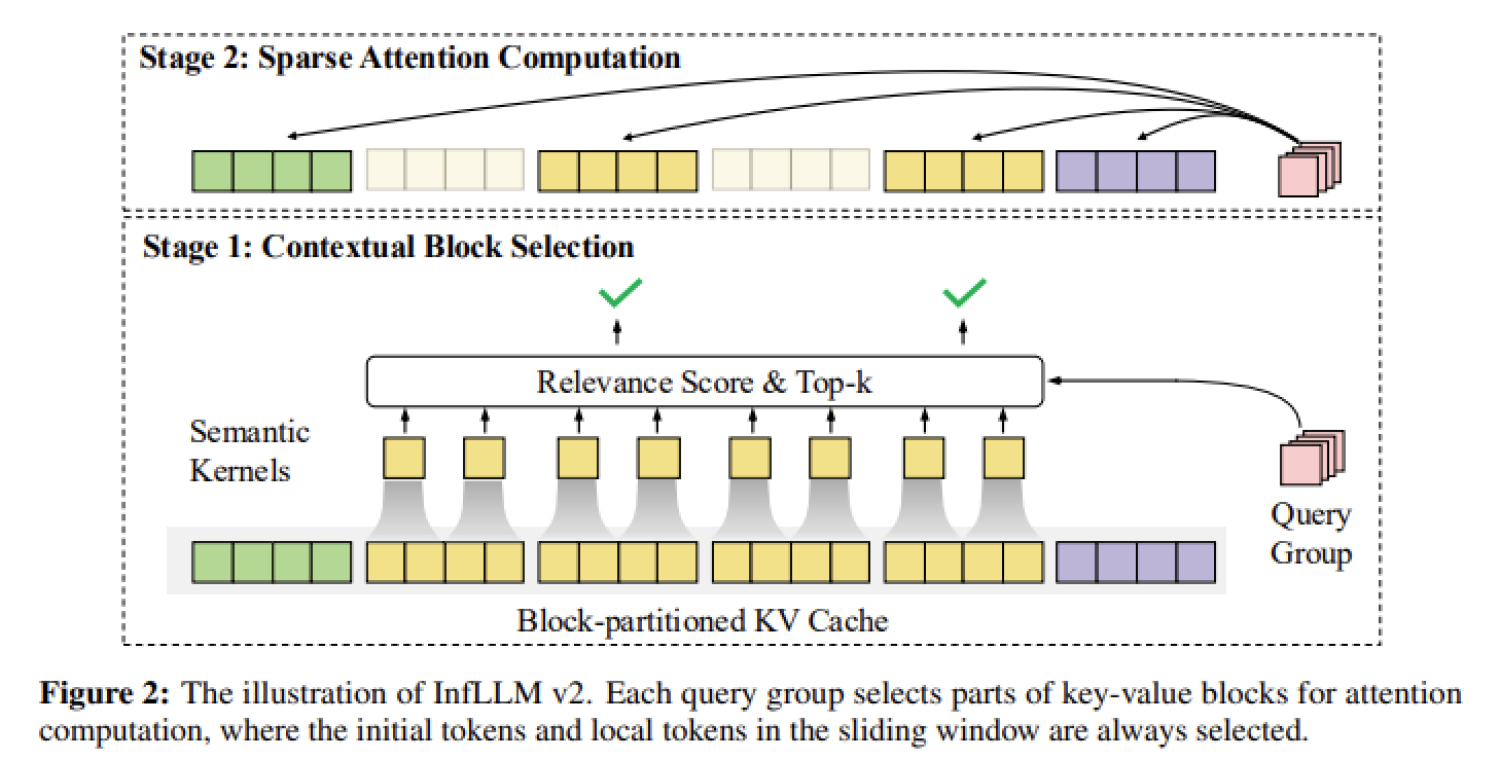

В основе MiniCPM4 лежит инновационная архитектура InfLLM v2 с разреженным вниманием, которая ускоряет обработку текста и существенно снижает требования к памяти. «InfLLM v2 позволяет уменьшить вычислительные затраты на 60% по сравнению с предыдущими решениями», — отмечают разработчики. Модель поддерживает работу с последовательностями до 128 тысяч токенов, сохраняя высокую скорость и качество генерации.

Для обучения MiniCPM4 использовался новый подход к очистке и отбору данных — UltraClean, что позволило ограничиться 8 триллионами токенов вместо 36 триллионов у конкурентов, не потеряв в качестве. Итоговые датасеты UltraFineWeb и UltraFineWeb-zh показали лучшие результаты на бенчмарках: +3,61% для английского и +1,98% для китайского языков по сравнению с аналогами.

В тестах MiniCPM4 (8B) набрала 32,24% на MMLU, 35,67% на ARC-C и 70,62% на ARC-E, опередив существующие модели. При этом скорость обработки длинных документов (до 128 тысяч токенов) оказалась в 7 раз выше, чем у Qwen3-8B, а средняя скорость декодирования превысила 200 токенов в секунду.

Модель поддерживает квантование (BitCPM4), что позволяет запускать её даже на устройствах с очень ограниченной памятью без потери качества. Для ускорения вывода используется система CPM.cu с оптимизацией под CUDA и спекулятивной выборкой, а UltraChat v2 обеспечивает дообучение на многоходовых диалогах с развитым рассуждением.

Эксперты отмечают, что MiniCPM4 открывает новые возможности для автономных ИИ-ассистентов, мобильных приложений и встраиваемых систем, где раньше использование крупных языковых моделей было невозможно из-за ограничений по ресурсам и приватности.