StepFun анонсировала Step-Audio-AQAA — первую полностью сквозную аудиоязыковую модель для естественного голосового взаимодействия между человеком и машиной.

Современные голосовые ассистенты и системы диалога до сих пор сталкиваются с ограничениями: для понимания и генерации речи они используют цепочку отдельных модулей — распознавание, обработку текста и синтез речи. Такой подход снижает скорость, накапливает ошибки и не позволяет гибко управлять интонацией или эмоциями. Новый прорыв предлагает Step-Audio-AQAA — модель, способную напрямую преобразовывать аудиовопрос в аудиоответ, полностью минуя этапы текстовой обработки.

В основе Step-Audio-AQAA лежит уникальная архитектура: два специализированных токенизатора анализируют как лингвистические, так и семантические особенности речи, а затем передают данные в мощную языковую модель Step-Omni с 130 миллиардами параметров. Финальный этап — преобразование токенов в живую, выразительную речь с помощью продвинутого вокодера. Такая система позволяет точно управлять тембром, скоростью и эмоциональной окраской голоса.

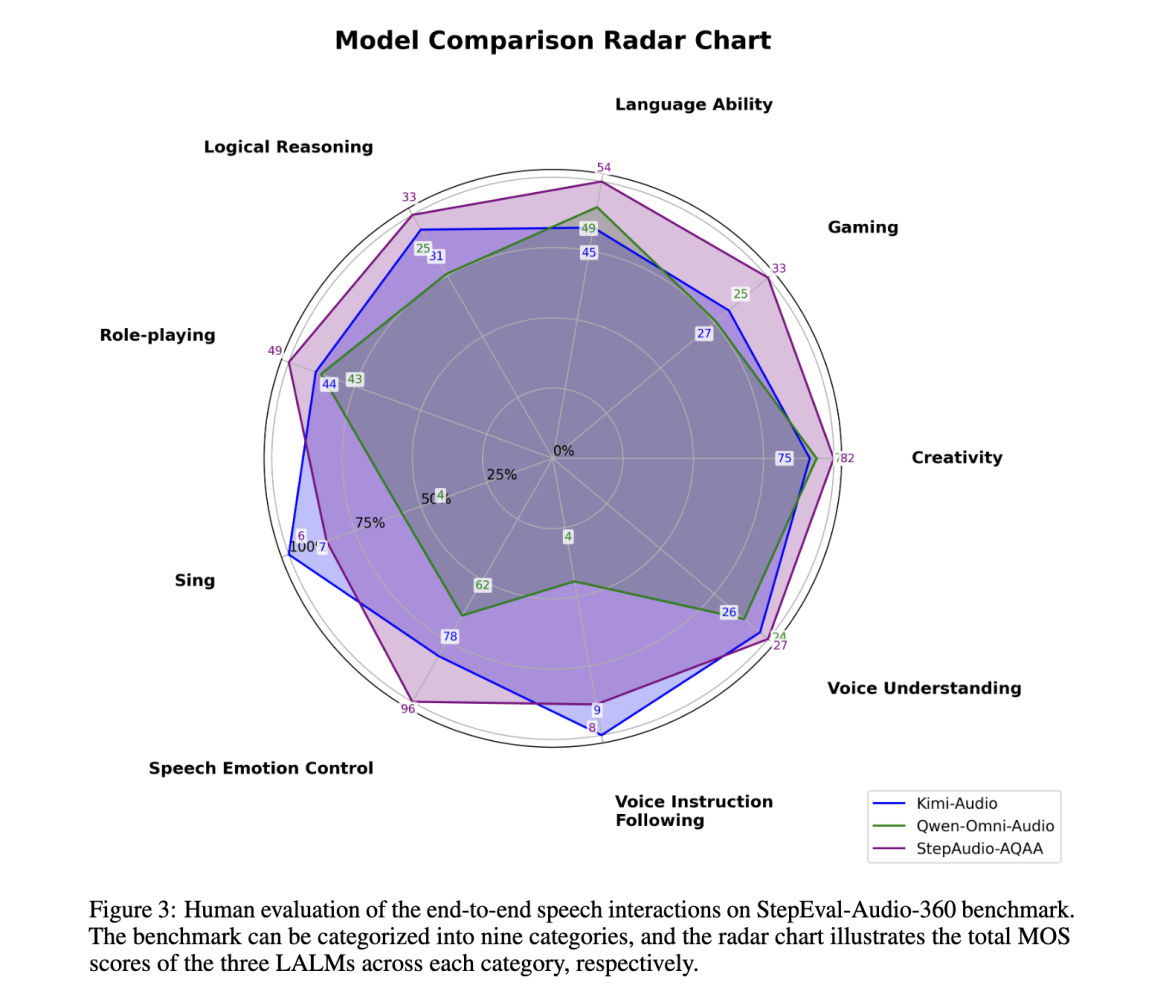

В ходе тестирования на многоязычном бенчмарке StepEval-Audio-360 новая модель показала лучшие результаты по сравнению с ведущими аналогами, такими как Kimi-Audio и Qwen-Omni. Особенно высоко оценили качество диалога, релевантность и достоверность ответов, а также способность воспроизводить сложные эмоции и интонации.

Эксперты отмечают, что появление Step-Audio-AQAA знаменует собой важный этап развития голосовых ИИ: теперь машины могут не только понимать речь, но и отвечать максимально естественно, эмоционально и быстро. Ожидается, что такие технологии найдут применение в голосовых помощниках, аудиокнигах, играх и системах hands-free, делая взаимодействие с ИИ по-настоящему живым и инклюзивным.