Введение в проблему объясняемости ИИ

С увеличением использования искусственного интеллекта (ИИ) в критически важных областях, таких как здравоохранение и автономные транспортные средства, растет необходимость в объяснимости моделей. Пользователи хотят понимать, как и почему модель принимает те или иные решения, чтобы оценить их надежность и обоснованность.

Концептуальные узкие места: что это и зачем они нужны

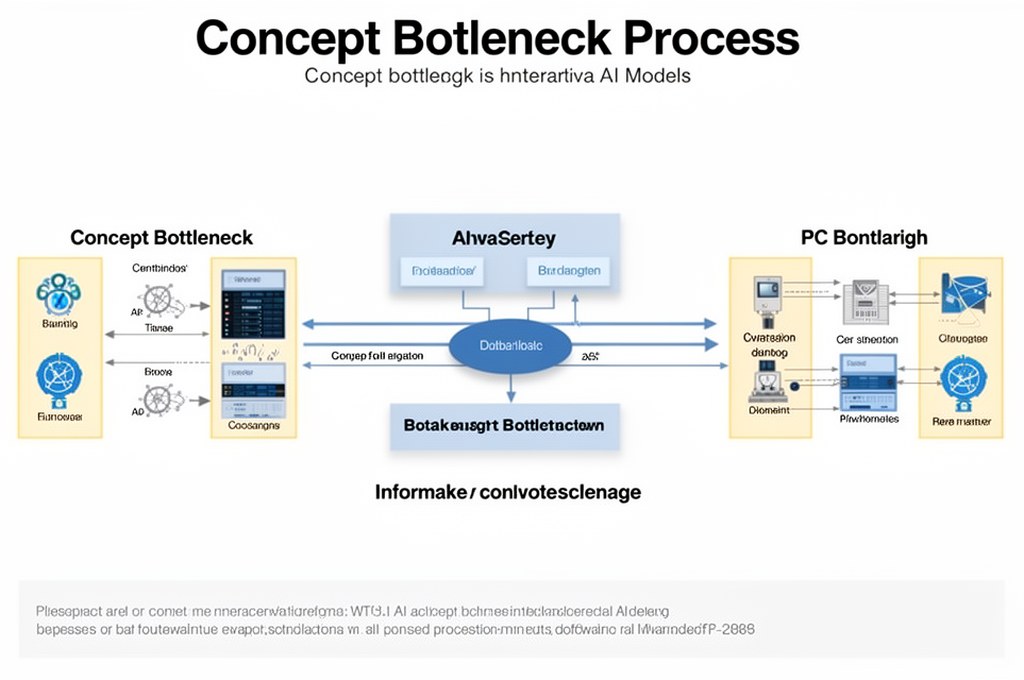

Концептуальные узкие места (Concept Bottleneck Models, CBMs) представляют собой метод, который позволяет моделям ИИ объяснять свои решения через набор понятий, понятных человеку. Эти понятия часто определяются экспертами заранее и используются моделью для создания предсказаний.

Проблемы существующих подходов

Одна из ключевых проблем состоит в том, что заранее определенные понятия могут оказаться нерелевантными для конкретной задачи или недостаточно детализированными, что снижает точность модели. Более того, модели могут использовать нежелательную информацию, что приводит к так называемой "утечке информации".

Новый подход от MIT: извлечение понятий из модели

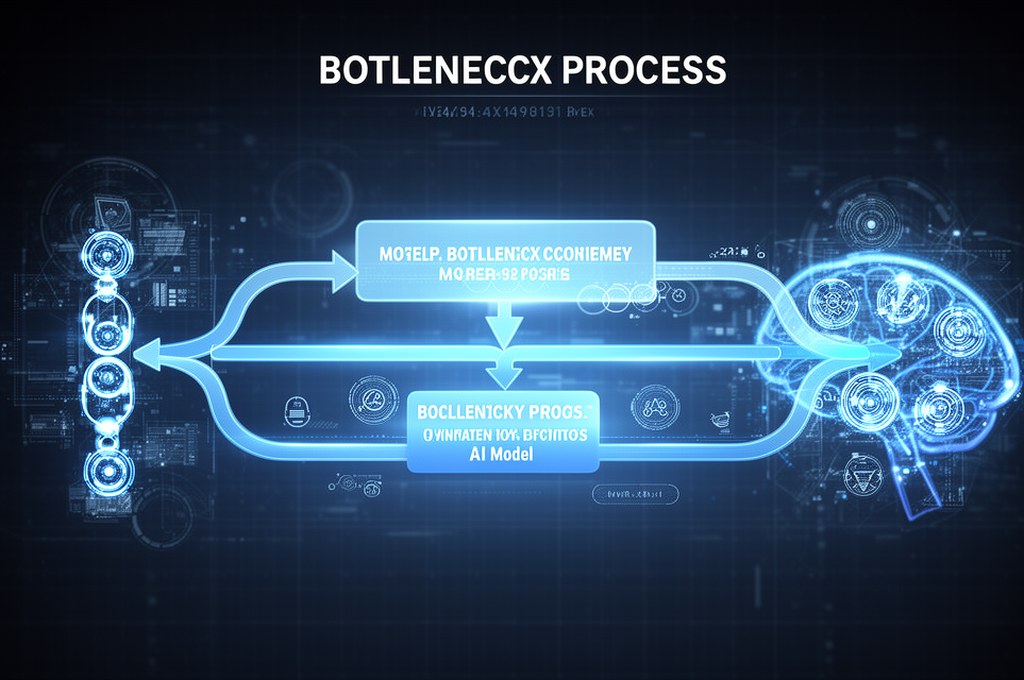

Исследователи из MIT предложили метод, который позволяет моделям использовать уже выученные в процессе обучения понятия. Это делает объяснения более точными и понятными. Их подход включает использование пары специализированных моделей машинного обучения, которые извлекают знания из целевой модели и переводят их в понятия на простом языке.

Как это работает

- Использование разряженного автоэнкодера для выбора наиболее релевантных признаков и их реконструкции в понятия.

- Описание каждого понятия с помощью мультимодальной модели языка (LLM).

- Аннотирование изображений в наборе данных, чтобы обучить модуль узкого места распознавать понятия.

Преимущества нового подхода

Новый метод показал более высокую точность и более точные объяснения по сравнению с существующими CBMs. Это особенно важно в задачах, таких как идентификация видов птиц или диагностика медицинских изображений. Ограничение модели в использовании лишь пяти понятий для каждого предсказания делает объяснения более понятными и релевантными.

Перспективы и дальнейшие исследования

Несмотря на успехи, существует еще необходимость в решении проблемы утечки информации и улучшении интерпретируемости моделей. В будущем исследователи планируют масштабировать свой метод, используя более крупные мультимодальные модели языка для аннотирования более объемных наборов данных.

Эти достижения открывают путь к использованию ИИ в новых сферах, таких как символический ИИ и графы знаний, что может привести к созданию более надежных и интерпретируемых систем.