Введение в проблему аллюцинаций в LLM

В последние годы большие языковые модели (LLM) стали основой многих приложений, от автоматизированных систем поддержки до инструментов для генерации текста. Однако, несмотря на их популярность, они часто сталкиваются с проблемой, известной как аллюцинации — это когда модель уверенно генерирует неправильные ответы. Вопреки распространенному мнению, это не проблема качества данных или недостатка в обучении. Это структурная особенность, обусловленная тем, как модели оптимизированы для выполнения своих задач.

Геометрия представлений в LLM

Чтобы понять, почему аллюцинации происходят, необходимо изучить внутреннюю геометрию представлений модели. Представьте, что каждое состояние модели на каждом слое — это точка в многомерном пространстве. Как модель обрабатывает запрос, эта точка перемещается, оставляя за собой путь. Исследования показали, что пути, которые ведут к правильным и неправильным ответам, имеют одинаковую длину, но различаются направлением. Это означает, что модель знает, где находится правильный ответ, но выбирает идти в другом направлении.

Коэффициент приверженности: когда подавление становится видимым

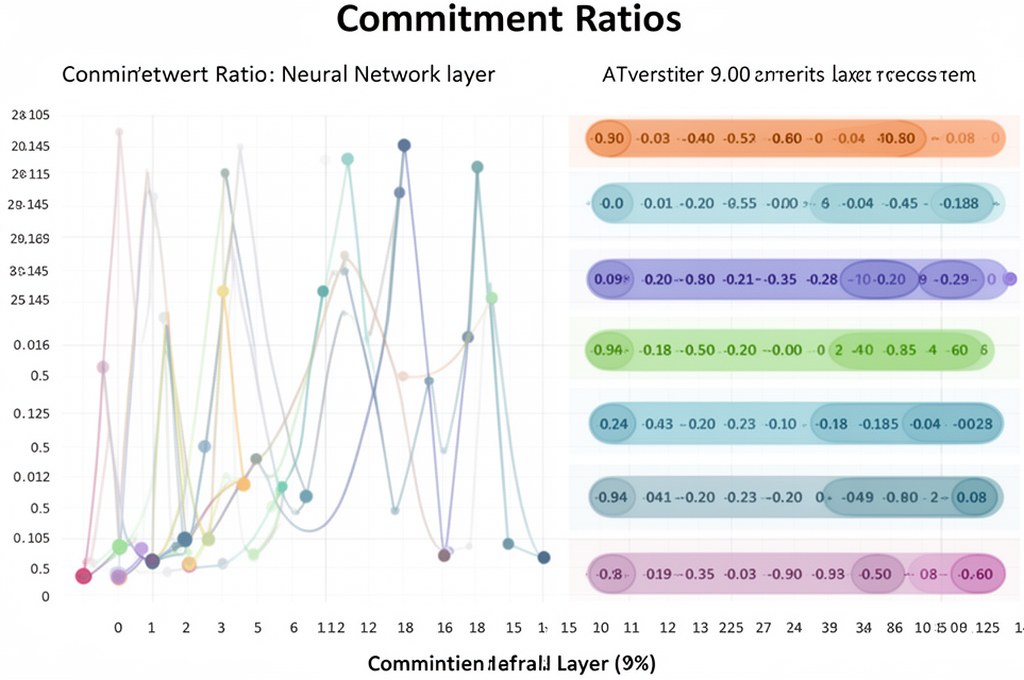

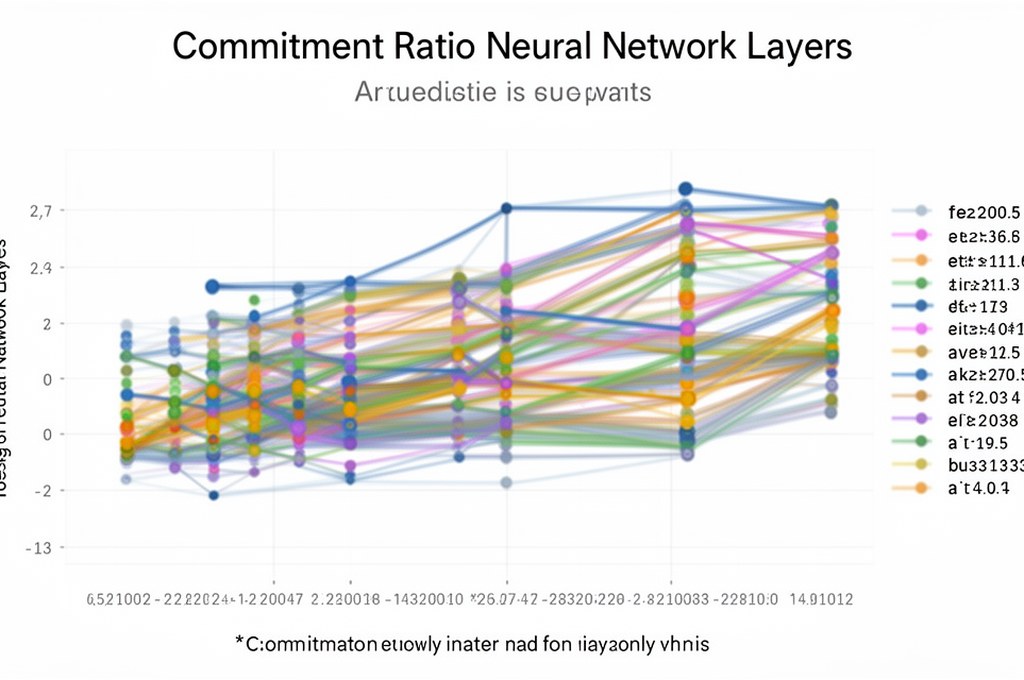

Для более глубокого понимания было введено понятие коэффициента приверженности (κ). Это метрика, показывающая, как много вероятностной массы модели активно направляется к правильному или неправильному токену на каждом слое. В процессе корректной обработки κ монотонно растет, демонстрируя наращивание приверженности правильному ответу. Однако при аллюцинации κ резко падает, достигая минимума в средних слоях сети. Это не просто ошибка извлечения данных. Модель сознательно отводит вероятности от правильного ответа.

Три режима поведения моделей

Исследования показали, что модели могут быть классифицированы на три группы по их поведению в отношении аллюцинаций:

- Модели с 1B параметров показывают начальную стадию перераспределения внимания, но подавление остается неполным.

- Модели с 1.6B–3B параметров демонстрируют промежуточное подавление, κ падает, но не так низко, как в более крупных моделях.

- Модели типа Gemma 2 2B, несмотря на меньший размер, достигают аналогичной глубины подавления, как и более крупные модели.

Практическое применение и ограничения

Изучение геометрии аллюцинаций позволяет создать детекторы, которые могут идентифицировать события подавления до их вывода. Однако эти детекторы должны быть специфичны для каждого домена и контекста применения. Универсальный детектор не будет работать эффективно. Эта информация критически важна для развертывания систем в производственных масштабах.

Что геометрия не может исправить

Механизм подавления, который был выявлен, не является багом, который можно устранить. Это непосредственное следствие функции оптимизации, используемой для обучения LLM. До тех пор, пока модели не будут иметь представления о мире, которые не основаны только на совместном появлении токенов, проблема будет сохраняться. Это требует разработки новых архитектур.

Почему это исследование важно

Понимание того, как и почему текущие LLM сталкиваются с аллюцинациями, является необходимым шагом для разработки более совершенных систем. Это исследование подчеркивает активный характер отклонений в представлениях и указывает на архитектурные ограничения, которые необходимо учитывать при разработке новых моделей.