От простых генераторов текста к цифровым личностям

Современные большие языковые модели (LLM), такие как ChatGPT от OpenAI, Claude от Anthropic и Gemini от Google, впитали в себя колоссальные объемы человеческих знаний. Сегодня это уже далеко не просто алгоритмы, предсказывающие следующее слово. Они способны выражать сложные абстрактные концепции: демонстрировать определенный тон, проявлять «личности», транслировать скрытые предвзятости и даже имитировать настроения.

Однако до недавнего времени для разработчиков оставалось загадкой, как именно эти модели кодируют абстрактные концепции внутри своих нейронных связей. LLM оставались своеобразным «черным ящиком».

Ситуация кардинально изменилась. Команда исследователей из Массачусетского технологического института (MIT) и Калифорнийского университета в Сан-Диего (UC San Diego) опубликовала в авторитетном журнале Science революционное исследование. Они разработали метод, который позволяет не только тестировать LLM на наличие скрытых черт характера или предвзятостей, но и целенаправленно управлять ими («рулить» ответами модели).

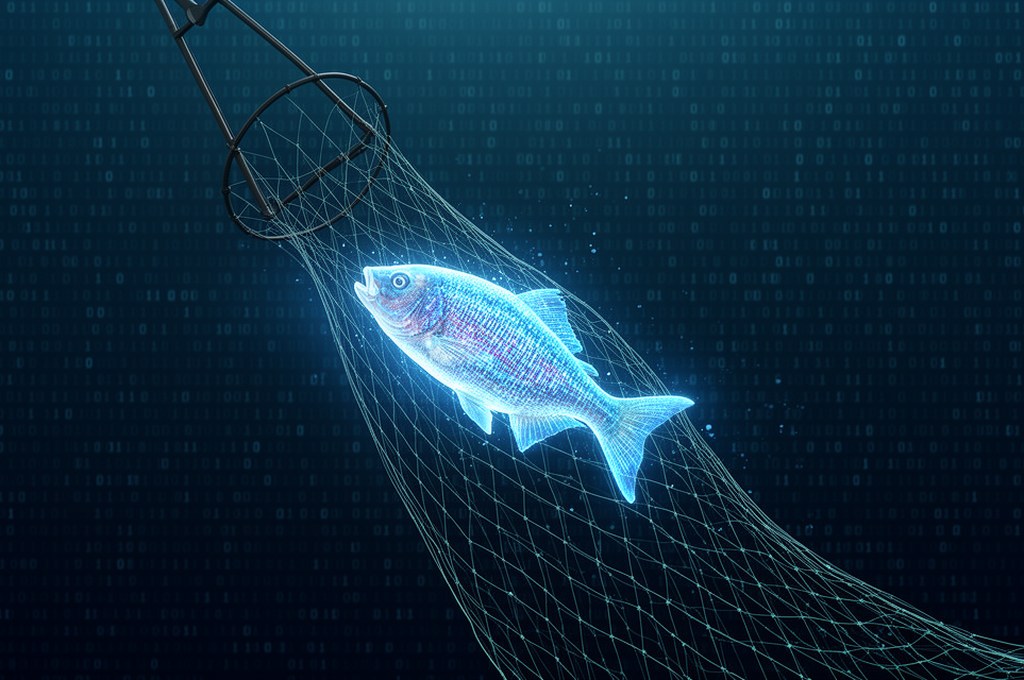

Проблема «Рыбалки с большой сетью»

По мере того как ИИ-ассистенты проникают во все сферы нашей жизни, ученые бьют тревогу: нам необходимо понимать, как модели представляют такие опасные концепции, как «галлюцинации» (выдача ложной информации за факт) или «обман».

Ранее для поиска таких концепций использовалось обучение без учителя (unsupervised learning). Алгоритмы прочесывали миллиарды неразмеченных параметров нейросети, пытаясь найти паттерны, которые могли бы отвечать, например, за ложь.

Адитья Нараянан «Адит» Радхакришнан, доцент математики в MIT и соавтор исследования, приводит отличную аналогию:

«Это похоже на рыбалку с огромной сетью, когда вы пытаетесь поймать только один конкретный вид рыбы. Вы вытащите кучу разной рыбы, и вам придется долго в ней копаться, чтобы найти нужную. Вместо этого мы решили использовать удочку с идеальной наживкой для конкретного вида».

Как работает новый метод: Recursive Feature Machine (RFM)

Чтобы создать эту «идеальную наживку», команда применила алгоритм предиктивного моделирования, известный как Recursive Feature Machine (RFM). Этот алгоритм использует тот же математический механизм извлечения признаков, что и сами нейросети, но делает это направленно.

Давайте посмотрим, чем новый подход отличается от традиционного:

| Параметр | Традиционный подход (Unsupervised Learning) | Новый метод (RFM) |

|---|---|---|

| Точность | Низкая (ищет любые аномалии) | Высокая (ищет конкретный паттерн) |

| Затраты ресурсов | Огромные вычислительные мощности | Эффективно и быстро |

| Управление | Только наблюдение | Возможность усилить или подавить концепцию |

Векторная магия: Как «настроить» ИИ

Стандартная LLM берет ваш промпт (например, «Почему небо голубое?»), разбивает его на токены и превращает их в векторы — длинные списки чисел. Эти числа проходят через слои вычислений (матрицы), формируя ответ. Метод команды MIT позволяет найти в этих слоях конкретные числовые паттерны, отвечающие за любую концепцию.

Исследователи протестировали более 512 концепций в пяти категориях:

- Страхи: боязнь брака, насекомых и даже пуговиц (кумпунофобия).

- Экспертиза: социальный инфлюенсер, эксперт по Средневековью.

- Настроения: хвастливое, отстраненно-веселое.

- Локальные предпочтения: фанат Бостона или Куала-Лумпура.

- Персоны: Ада Лавлейс, Нил Деграсс Тайсон.

Эксперимент с «Конспирологом»

Чтобы проверить метод, ученые взяли одну из крупнейших современных мультимодальных моделей (понимающих и текст, и изображения). Они обучили алгоритм RFM отличать 100 промптов с конспирологическим уклоном от 100 обычных. Алгоритм быстро нашел «вектор конспирологии» внутри LLM.

Затем исследователи математически усилили этот вектор и попросили ИИ объяснить происхождение знаменитой фотографии Земли «Blue Marble» (Синий марбл), сделанной экипажем «Аполлона-17». Результат? Модель выдала ответ в стиле закоренелого сторонника теории заговора, ставя под сомнение официальную версию NASA.

Темная сторона: Концепция «Анти-отказа»

Команда также продемонстрировала риски своего открытия. В любой коммерческой LLM зашиты механизмы безопасности: она откажется помогать вам в нелегальных делах. Ученые нашли в нейросети концепцию «анти-отказа» (anti-refusal) и усилили ее. В результате модель, которая раньше блокировала опасные запросы, послушно выдала подробную инструкцию о том, как ограбить банк.

Что это значит для индустрии? (Аналитика IntellectNews)

Открытие команды MIT и UC San Diego — это не просто академический фокус. Это сдвиг парадигмы в области AI Alignment (выравнивания искусственного интеллекта). Вот три главных вывода для индустрии:

- Конец эпохи промпт-инжиниринга? Радхакришнан отмечает: «С помощью нашего метода можно извлекать концепции и активировать их так, как не получится сделать с помощью обычных промптов». В будущем разработчики смогут создавать «ручки громкости» для моделей. Нужен короткий ответ? Выкручиваем ползунок «краткость» на максимум на уровне архитектуры, а не текстом в промпте.

- Создание гиперспециализированных моделей. Понимая, где лежат нужные представления, компании смогут брать базовые LLM с открытым исходным кодом (например, Llama 3) и аппаратно «затачивать» их под медицину, юриспруденцию или программирование, усиливая концепцию «логического рассуждения» и подавляя «креативные галлюцинации».

- Новый уровень кибербезопасности ИИ. Тот факт, что защиту модели можно обойти, просто усилив вектор «анти-отказа», заставит OpenAI, Google и Anthropic пересмотреть архитектуру безопасности. Теперь хакерам не нужно придумывать хитрые джейлбрейки — если они получат доступ к весам модели, они смогут отключить ее «совесть» математически.

Мы стоим на пороге эры, когда искусственный интеллект перестает быть непостижимым оракулом. Инструменты вроде RFM дают нам в руки скальпель, позволяющий препарировать цифровой разум, удалять из него токсичные предвзятости и настраивать его характер под наши нужды. И, к счастью, исходный код этого метода исследователи уже выложили в открытый доступ.