Проблема «всезнающего» ИИ

Современные системы искусственного интеллекта в медицине часто ведут себя как «оракулы» — они дают уверенные ответы, даже когда ошибаются. Исследователи из MIT, Beth Israel Deaconess Medical Center и Гарвардской медицинской школы предлагают радикально иной подход: «скромный» ИИ, который открыто сообщает о своей неуверенности и запрашивает дополнительную информацию. Это не просто техническое усовершенствование — это смена парадигмы взаимодействия человека и машины.

Почему это важно? Исследования показывают, что врачи в отделениях интенсивной терапии склонны делегировать решения ИИ, даже когда их собственная интуиция подсказывает иное. Если система выглядит авторитетной, пациенты и врачи с большей вероятностью примут неверную рекомендацию. «Мы используем ИИ как оракула, но мы можем использовать его как тренера или настоящего второго пилота», — объясняет Лео Энтони Сели, старший научный сотрудник MIT и практикующий врач.

Архитектура скромности: как это работает

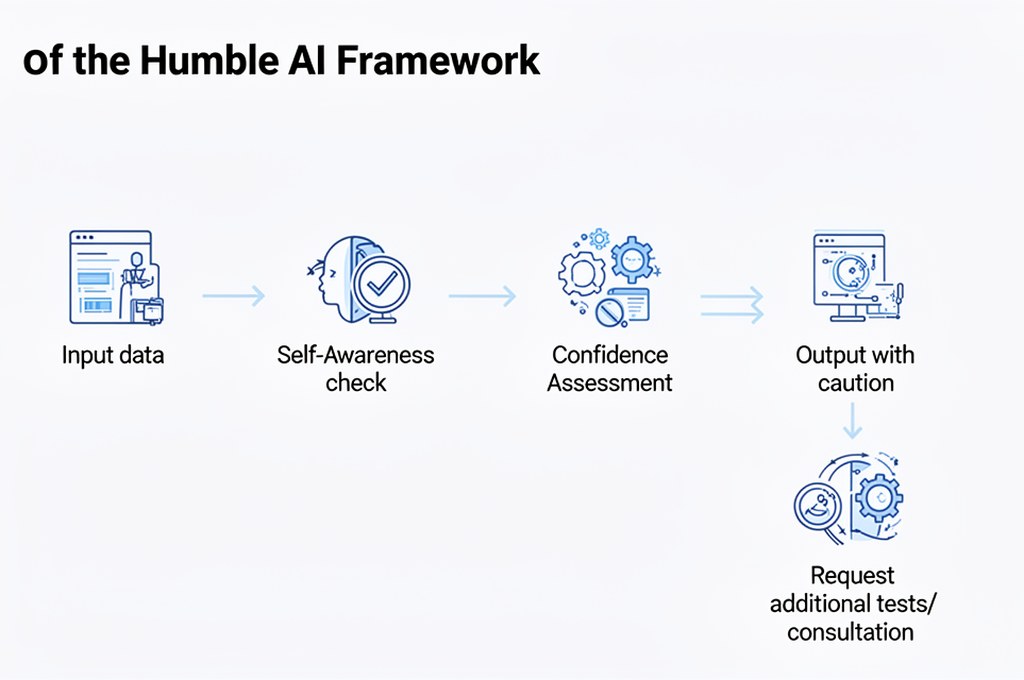

Команда MIT разработала фреймворк, включающий несколько ключевых модулей. Первый из них — «Эпистемический показатель добродетели» (Epistemic Virtue Score), созданный Янаном Арсланом и Куртом Бенке из Мельбурнского университета. Этот модуль оценивает собственную уверенность модели в каждом конкретном клиническом сценарии, учитывая неполноту и сложность данных.

Если система обнаруживает, что её уверенность превышает то, что оправдано имеющимися доказательствами, она может:

- Приостановить вывод и пометить несоответствие;

- Запросить конкретные тесты или историю болезни для устранения неопределённости;

- Рекомендовать консультацию специалиста.

«Это как иметь второго пилота, который говорит вам: „Вам нужен свежий взгляд, чтобы лучше понять этого сложного пациента“», — комментирует Сели. Такой подход превращает ИИ из «чёрного ящика» в прозрачного партнёра, который не только даёт ответы, но и сигнализирует, когда к ним следует относиться с осторожностью.

От оракула к со-пилоту: изменение роли ИИ

Себастьян Андрес Кахас Ордоньес, ведущий автор исследования, подчёркивает: «Мы пытаемся включить людей в эти человеко-ИИ системы, чтобы облегчить коллективное размышление и переосмысление, вместо того чтобы иметь изолированных ИИ-агентов, которые делают всё. Мы хотим, чтобы люди становились более творческими благодаря использованию ИИ».

Это философский сдвиг: вместо замены врача ИИ становится инструментом расширения возможностей. Врач остаётся главным лицом, принимающим решения, а ИИ предоставляет обоснованные рекомендации с указанием степени их надёжности. Такой подход особенно важен в условиях неопределённости, когда данные неполны или противоречивы.

Проблемы данных: от MIMIC к инклюзивности

У команды MIT есть и более широкая повестка. Многие ИИ-модели, включая их собственную базу MIMIC (Medical Information Mart for Intensive Care), обучаются на публичных данных из США. Это может приводить к систематическим смещениям и исключению целых групп пациентов — например, жителей сельских районов или людей с ограниченным доступом к медицинской помощи.

«Мы заставляем их ставить под сомнение набор данных. Уверены ли они в своих обучающих и проверочных данных? Думают ли они, что некоторые пациенты были исключены, намеренно или нет, и как это повлияет на модель?» — говорит Сели. Для решения этой проблемы MIT Critical Data проводит воркшопы, где вместе работают специалисты по данным, врачи, социологи и пациенты. Цель — убедиться, что данные отражают все факторы, влияющие на прогноз, и не кодируют структурное неравенство.

Практическое внедрение и перспективы

Команда уже работает над внедрением нового фреймворка в системы на основе MIMIC и тестирует его с врачами в Beth Israel Lahey Health. Потенциальные области применения включают анализ рентгеновских снимков, подбор оптимального лечения в отделениях неотложной помощи и персонализированную терапию.

Сели признаёт: «Мы не можем остановить или даже замедлить развитие ИИ не только в здравоохранении, но и в каждом секторе. Но мы должны быть более осознанными и вдумчивыми в том, как мы это делаем».

Ключевые выводы для индустрии

| Аспект | Традиционный ИИ | «Скромный» ИИ |

|---|---|---|

| Роль | Оракул, дающий окончательный ответ | Со-пилот, предлагающий варианты с оценкой уверенности |

| Поведение при неопределённости | Игнорирует или маскирует | Открыто сообщает и запрашивает дополнительную информацию |

| Влияние на врача | Склоняет к делегированию решений | Стимулирует критическое мышление и проверку |

| Прозрачность | Низкая («чёрный ящик») | Высокая (объясняет основания) |

| Работа с данными | Обучается на доступных данных без критики | Активно выявляет пробелы и смещения |

Заключение: будущее за коллаборативным ИИ

Работа MIT — это важный шаг к созданию ИИ, который не просто «умнее», но и мудрее. Вместо того чтобы стремиться к абсолютной точности (что невозможно в сложных клинических сценариях), система учится быть честной о своих ограничениях. В эпоху, когда ИИ всё активнее внедряется в медицину, такой подход может стать стандартом безопасности и эффективности. В конце концов, лучший партнёр — это не тот, кто никогда не ошибается, а тот, кто вовремя предупреждает: «Проверь меня».

Следующие шаги — масштабирование фреймворка на другие области, от финансов до юриспруденции, где цена ошибки также высока. Идея «скромного» ИИ может оказаться универсальным принципом проектирования для всех критически важных систем.