Введение в проблему обучения LLM

Современные большие языковые модели (LLM) способны решать сложные задачи, разлагая их на серию более простых шагов. Такие модели активно используются в задачах, требующих многокомпонентного планирования и сложного программирования. Однако обучение этих моделей требует значительных вычислительных ресурсов и энергии, что делает процесс дорогостоящим и неэффективным.

Эффективное использование простоя

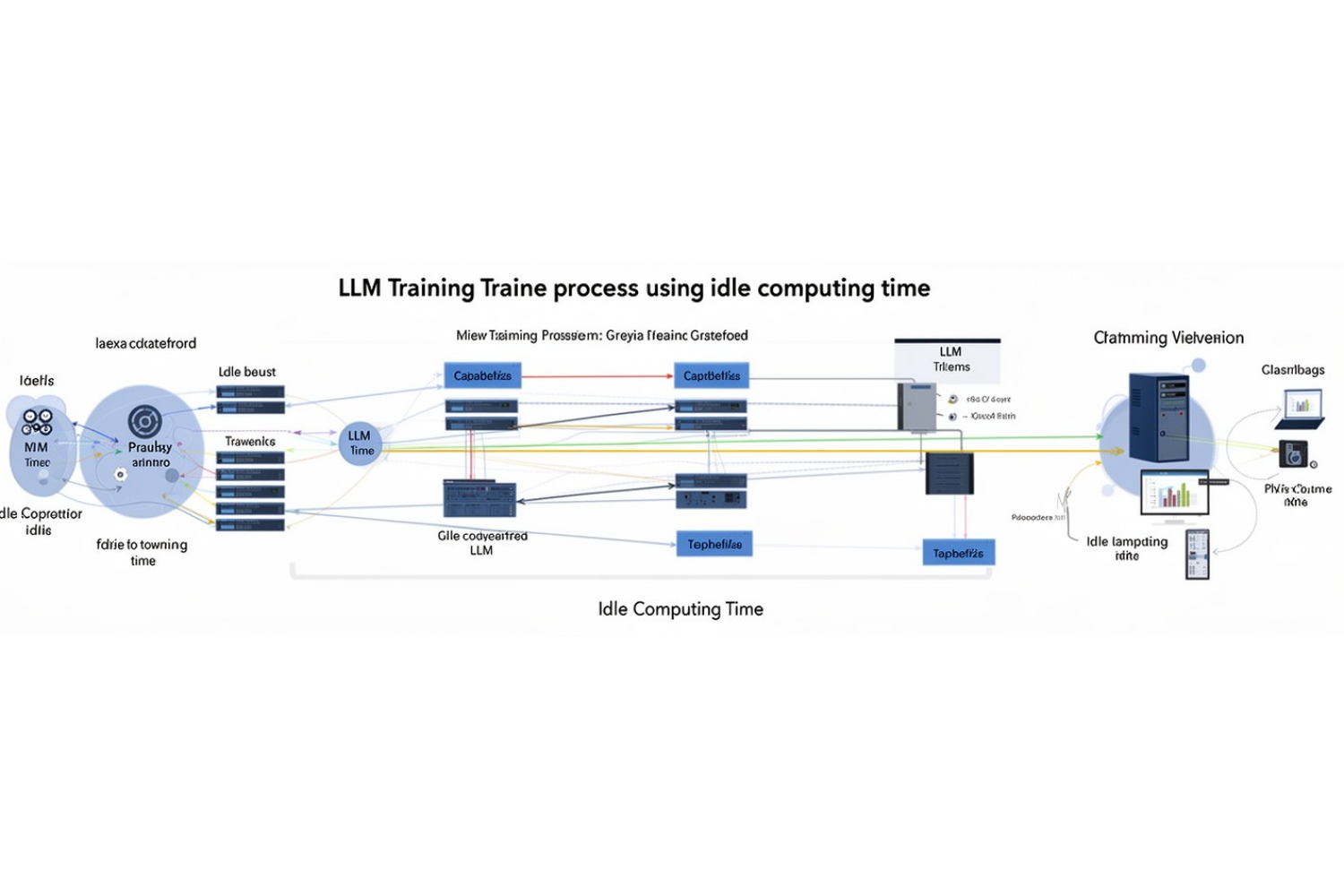

Исследователи из MIT предложили инновационный метод, позволяющий использовать простои вычислительных ресурсов для ускорения обучения LLM. Этот метод автоматически обучает более маленькую и быструю модель, которая предсказывает результаты работы основной модели, а затем проверяется на ней. Такой подход позволяет значительно ускорить процесс обучения без потери точности.

Преимущества и возможности метода TLT

Ключевым элементом системы является способность адаптивно обучать и развёртывать меньшую модель, которая активируется только при простое некоторых процессоров. Это позволяет ускорить обучение без дополнительных затрат на ресурсы.

Технология Taming the Long Tail (TLT)

Метод TLT включает в себя два основных компонента: адаптивный тренер драфтера и адаптивный двигатель раскатки. Первый компонент использует время простоя для обучения драфтера на лету, а второй управляет процессом спекулятивного декодирования, выбирая оптимальную стратегию для обработки каждого нового набора входных данных.

Эффективность и перспективы

Эксперименты показали, что использование TLT позволяет ускорить обучение между 70% и 210%, сохраняя при этом точность моделей. Это может существенно сократить затраты и увеличить энергоэффективность при разработке LLM для таких приложений, как прогнозирование финансовых трендов или выявление рисков в энергетических сетях.

В будущем исследователи планируют интегрировать TLT в более широкие рамки обучения и инференса и искать новые приложения в области обучения с подкреплением, которые могут быть ускорены с помощью этого подхода.

Заключение

Метод TLT представляет собой значительный шаг вперед в области эффективных вычислений ИИ, позволяя преодолеть узкие места в обучении моделей LLM. Это открывает новые перспективы для развития технологий искусственного интеллекта и их применения в различных сферах.