Введение в проблему ранжирования LLM

В современном мире, когда компании выбирают большие языковые модели (LLM) для решения задач, таких как обобщение отчетов о продажах или обработка клиентских запросов, они сталкиваются с огромным количеством доступных моделей. Для упрощения выбора многие обращаются к платформам ранжирования LLM, которые агрегируют пользовательские отзывы и вычисляют, какая модель лучше всего справляется с определенными задачами.

Однако исследователи MIT обнаружили, что небольшое количество пользовательских взаимодействий может существенно исказить результаты, заставляя пользователей ошибочно считать одну модель идеальным выбором для конкретного случая использования. Их исследование показывает, что удаление лишь небольшой доли данных может изменить рейтинги моделей.

Как маленькие изменения данных могут изменить ранжирование

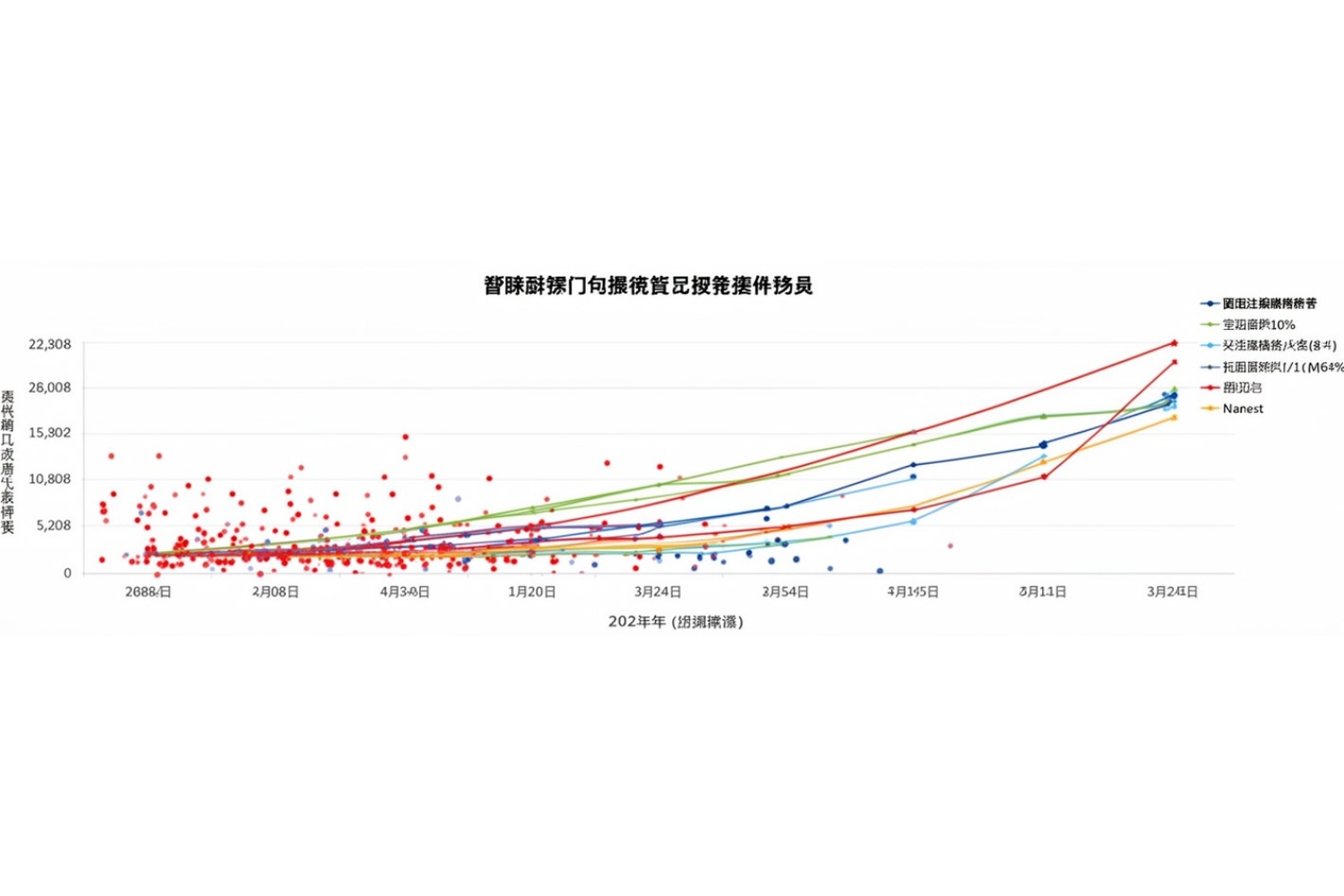

В своем исследовании исследователи разработали метод для оценки платформ ранжирования и выявления их уязвимостей. Они обнаружили, что удаление некоторых ключевых голосов может значительно изменить результаты, позволяя пользователям оценить влияние этих голосов на итоговые рейтинги.

Например, на одной из платформ удаление всего двух голосов из более чем 57,000 изменило лидирующую модель. Это подчеркивает необходимость более строгих стратегий оценки моделей, так как текущие методы могут вводить в заблуждение.

Проблемы общего характера и их решения

Проблема, выявленная MIT, заключается в том, что пользователи, полагающиеся на платформы ранжирования, могут принимать решения, имеющие существенные финансовые последствия для бизнеса. Если высоко оцененная LLM зависит всего от пары пользовательских отзывов, нельзя гарантировать, что она будет стабильно превосходить другие модели при развертывании.

Исследователи также предложили несколько улучшений, таких как сбор более детализированных отзывов и использование человеческих посредников для оценки краудсорсинговых ответов. Эти меры могут помочь снизить вероятность ошибки в ранжировании.

Потенциальные последствия для индустрии

Для индустрии это исследование означает необходимость пересмотра способов оценки и выбора LLM. Компании должны осознавать, что текущие платформы ранжирования могут быть ненадежными, и рассматривать альтернативные подходы к оценке моделей. Это может включать в себя внутреннее тестирование моделей на конкретных наборах данных, чтобы гарантировать, что выбранная модель действительно подходит для их уникальных нужд.

Кроме того, исследование может стимулировать разработку новых методов, которые будут учитывать шум и ошибки пользователей, чтобы предоставлять более точные и надежные результаты.

Заключение

Работа MIT является важным шагом в понимании того, как платформы ранжирования могут быть уязвимы к изменениям данных. Это подчеркивает необходимость более тщательной и осознанной оценки LLM, чтобы обеспечить, что бизнес-решения, основанные на этих моделях, будут надежными и обоснованными.