Введение в концепцию объяснимости ИИ

С развитием искусственного интеллекта (ИИ) важность объяснимости его решений становится все более актуальной. Особенно это касается областей, где ошибка может стоить человеческой жизни, таких как медицинская диагностика и автономное вождение. Новая методика, разработанная учеными из MIT, позволяет моделям компьютерного зрения объяснять свои прогнозы с использованием понятных человеку концепций.

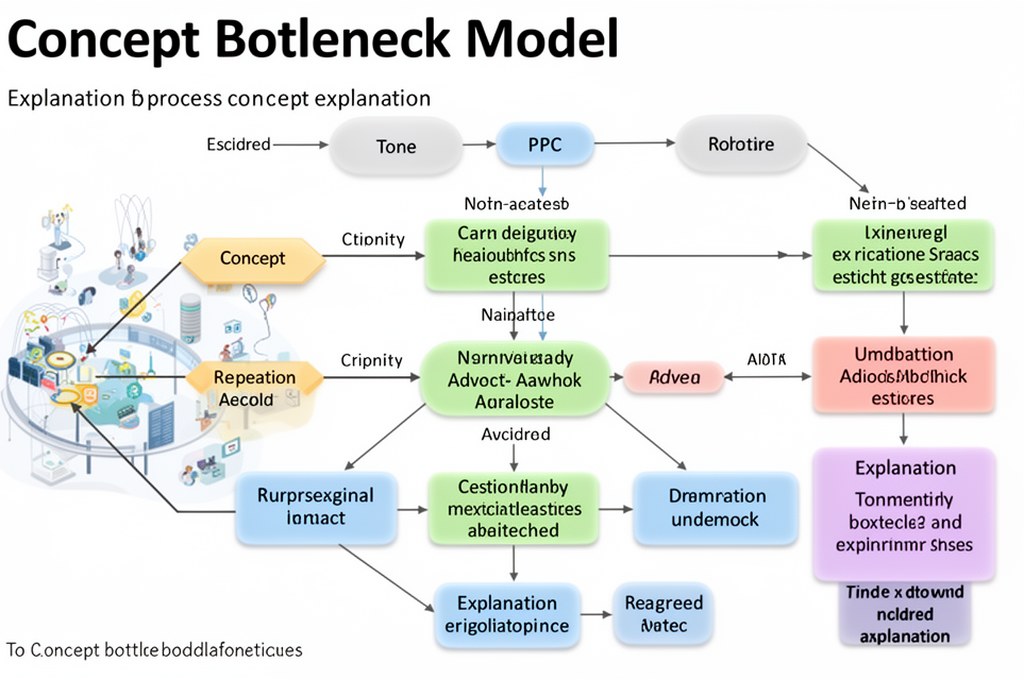

Бутылочное горлышко концепций: как это работает?

Модели бутылочного горлышка концепций (Concept Bottleneck Models, CBM) добавляют промежуточный шаг, заставляя модель сначала предсказать присутствие определенных концепций в изображении, а затем использовать эти концепции для окончательного предсказания. Это позволяет пользователям лучше понимать, почему модель сделала тот или иной вывод.

Например, модель, определяющая виды птиц, может сначала отметить такие характеристики, как «желтые ноги» и «синие крылья», прежде чем предсказать, что перед нами ласточка.

Преодоление ограничений традиционных CBM

Традиционные CBM сосредоточены на заранее определенных концепциях, которые могут быть недостаточно подробными или даже неуместными для конкретной задачи. Исследователи из MIT предложили новую стратегию, извлекая концепции, уже выученные моделью на этапе ее обучения. Это позволяет улучшить точность и ясность объяснений.

Инновационная методика MIT

Новая методика основана на использовании пары специализированных моделей машинного обучения для автоматического извлечения знаний из целевой модели и преобразования их в понятные человеку концепции.

- Автоэнкодер выбирает наиболее релевантные характеристики и реконструирует их в виде ограниченного числа концепций.

- Мультимодальная языковая модель (LLM) описывает каждую концепцию на простом языке и аннотирует изображения, определяя, какие концепции присутствуют в каждом из них.

Контроль над концепциями

Одним из важных аспектов новой методики является ограничение на использование не более пяти концепций для каждого предсказания. Это позволяет модели выбирать наиболее релевантные концепции и делает объяснения более понятными.

Сравнение с существующими CBM показало, что методика MIT обеспечивает более высокую точность предсказаний при более точных объяснениях.

Будущие перспективы и выводы

Несмотря на успехи, остается проблема утечки информации, когда модель может использовать нежелательные концепции. В будущем исследователи планируют изучить возможные решения этой проблемы, возможно, добавляя дополнительные модули бутылочного горлышка концепций.

Профессор Андреас Хотхо, не участвовавший в исследовании, отметил, что эта работа открывает путь к более естественным объяснениям и создает мост к символьному ИИ и графам знаний.