Введение в концепцию объясняемых AI моделей

С каждым годом искусственный интеллект (AI) всё глубже внедряется в нашу жизнь, и его влияние становится всё более значимым. Однако с развитием AI технологий возникает вопрос их объясняемости, особенно в критически важных сферах, таких как здравоохранение и автономное вождение.

В новой работе MIT представлена методика, позволяющая моделям компьютерного зрения объяснять свои прогнозы с помощью понятных человеку концепций, что может значительно повысить доверие пользователей к этим системам.

Что такое концептуальное узкое место?

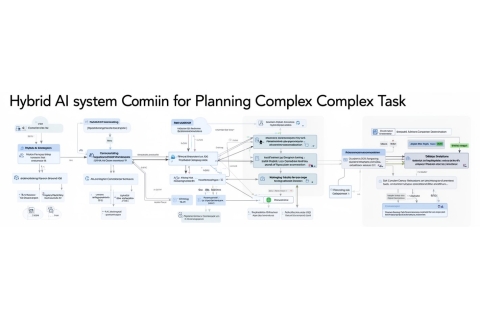

Одним из популярных подходов к улучшению объясняемости AI является использование моделей концептуального узкого места (Concept Bottleneck Models, CBMs). Эти модели добавляют промежуточный этап, заставляя систему сначала идентифицировать концепции, присутствующие на изображении, прежде чем сделать окончательное предсказание.

Например, модель, определяющая вид птицы, может сначала выбрать такие концепции, как «жёлтые ноги» и «синие крылья», прежде чем предсказать, что это сельская ласточка.

Проблемы традиционных подходов

Однако традиционные методы часто сталкиваются с проблемой, что заранее заданные концепции могут не подходить для конкретной задачи, или же модель может использовать нежелательную информацию, что известно как утечка информации.

Новый подход к обучению концепциям

Исследователи из MIT предложили иной подход: использовать знания, которые модель уже приобрела во время обучения, и преобразовать их в текст, понятный человеку.

Для этого они использовали специализированную модель глубокого обучения — разреженный автоэнкодер, который выбирает наиболее релевантные признаки и реконструирует их в небольшое количество концепций. Затем мультимодальная языковая модель (LLM) описывает каждую концепцию на простом языке.

Контроль над концепциями

Для предотвращения использования неизвестных или нежелательных концепций, модель ограничена в использовании только пяти концепций для каждого предсказания. Это также делает объяснения более понятными.

Применение и перспективы

Когда исследователи протестировали свой подход на задачах, таких как определение видов птиц и идентификация кожных поражений на медицинских изображениях, их метод достиг самой высокой точности, предоставляя более точные объяснения.

Эта работа открывает новые возможности для разработки более надежных и объясняемых AI систем, что особенно важно в высокорисковых областях.

Будущее исследований в этом направлении включает изучение решений для проблемы утечки информации и масштабирование метода с использованием более крупных языковых моделей для аннотирования больших наборов данных, что может повысить производительность.