В мире искусственного интеллекта одним из ключевых вызовов является объяснимость моделей. В критически важных областях, таких как здравоохранение и автономное вождение, понимание причин, по которым модель ИИ сделала определённый вывод, может быть жизненно важным. Новый подход, разработанный учеными Массачусетского технологического института (MIT), обещает сделать компьютерные модели более прозрачными и надежными.

Значение объяснимости в критических приложениях

Когда речь заходит о медицинской диагностике или управлении автономными транспортными средствами, пользователям нужно быть уверенными в том, что они могут доверять выводам, сделанным ИИ. Ошибки здесь могут стоить дорого, как в прямом, так и в переносном смысле. Поэтому способность модели объяснять свои предсказания становится не просто желательной, а необходимой.

Техника концептуальных узких мест

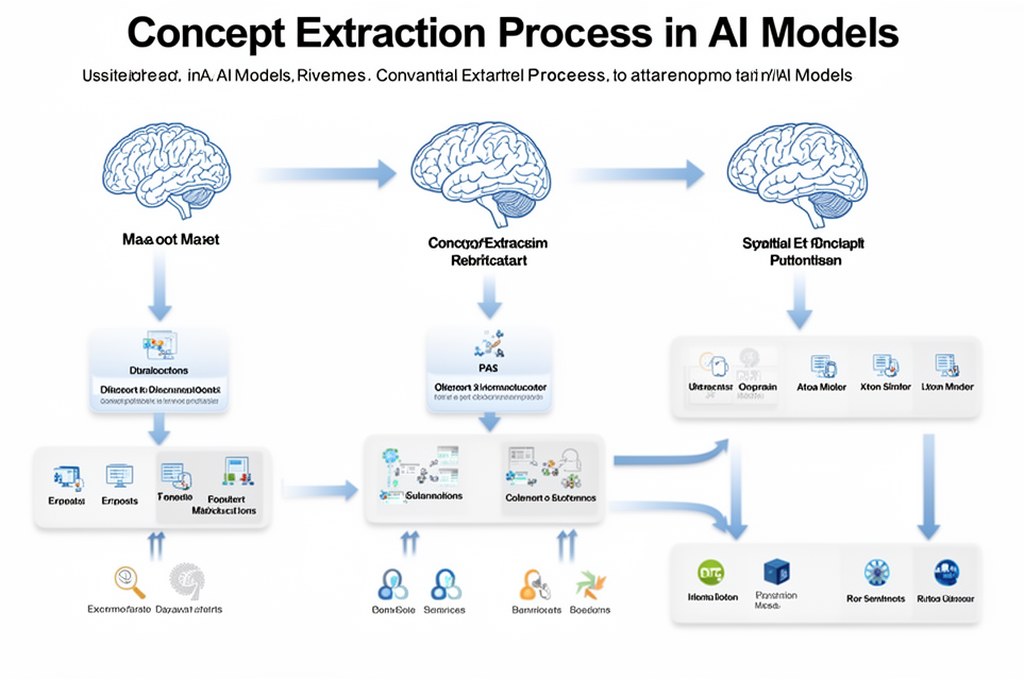

Одним из методов достижения объяснимости является моделирование концептуальных узких мест (Concept Bottleneck Models, CBM). Этот подход добавляет промежуточный шаг, в котором модель сначала предсказывает концепции, присутствующие на изображении, а затем использует их для окончательного предсказания. Такой «бутылочное горло» помогает понять, как модель пришла к своему выводу.

Например, модель, идентифицирующая виды птиц, может сначала выявить такие концепции, как «жёлтые ноги» или «синие крылья», прежде чем сделать вывод о том, что перед нами ласточка.

Новый подход: извлечение знаний из модели

Исследователи из MIT предложили новый способ создания CBM, который использует знания, уже выученные моделью. Вместо того чтобы полагаться на заранее определённые концепции, которые могут быть не всегда релевантны, их метод извлекает уже обученные концепции из модели и переводит их на понятный человеку язык.

Автоэнкодеры и мультимодальные модели

В основе метода лежит специализированная глубокая модель обучения — разряженный автоэнкодер, который выбирает наиболее важные особенности, выученные моделью, и превращает их в несколько понятий. Затем мультимодальная языковая модель (LLM) описывает каждую из этих концепций простым языком.

Эта мультимодальная LLM также аннотирует изображения в наборе данных, определяя, какие концепции присутствуют и отсутствуют в каждом из них. Затем исследователи используют этот аннотированный набор данных для обучения модуля концептуального узкого места, который интегрируется в целевую модель, заставляя её делать предсказания только с использованием выученных концепций.

Преимущества и вызовы нового подхода

Один из основных вызовов при разработке этого метода заключался в необходимости убедиться, что LLM правильно аннотировала концепции, а разряженный автоэнкодер выделил понятия, понятные человеку. Чтобы предотвратить использование неизвестных или нежелательных концепций, модель ограничивается использованием только пяти концепций для каждого предсказания.

Будущее объяснимого ИИ

Хотя новый метод показал высокую точность и более точные объяснения, чем традиционные CBM, всё ещё остаётся проблема баланса между интерпретируемостью и точностью. Исследователи планируют изучить возможные решения проблемы утечки информации и масштабировать метод, используя более крупные LLM для аннотации более объёмных наборов данных.

Этот подход открывает новые возможности для интеграции объяснимого ИИ с символическим ИИ и графами знаний, что может значительно улучшить прозрачность и ответственность моделей ИИ в будущем.