Введение в проблему самоуверенности больших языковых моделей

Большие языковые модели (LLM), такие как ChatGPT, могут производить убедительные, но неточные ответы. Это представляет собой значительный риск, особенно в областях высокой важности, таких как здравоохранение и финансы. Исследователи из MIT предложили новый подход для оценки неопределенности, который позволяет более надежно выявлять ошибки в самоуверенных ответах моделей.

Традиционные методы и их ограничения

Одним из популярных методов оценки надежности LLM является многократное предъявление одного и того же запроса модели, чтобы проверить, насколько она уверена в своих ответах. Однако, даже самые продвинутые модели могут быть уверенными, но при этом неправыми. Это связано с тем, что традиционные методы измеряют алеторическую неопределенность, то есть внутреннюю уверенность модели в своем предсказании.

Модель может быть уверенной даже в случае, если она абсолютно неправа. Для более точной оценки истинной неопределенности важно учитывать эпистемическую неопределенность, связанную с тем, правильно ли выбрана модель для решения данной задачи.

Новый метод от MIT: кросс-модельные расхождения

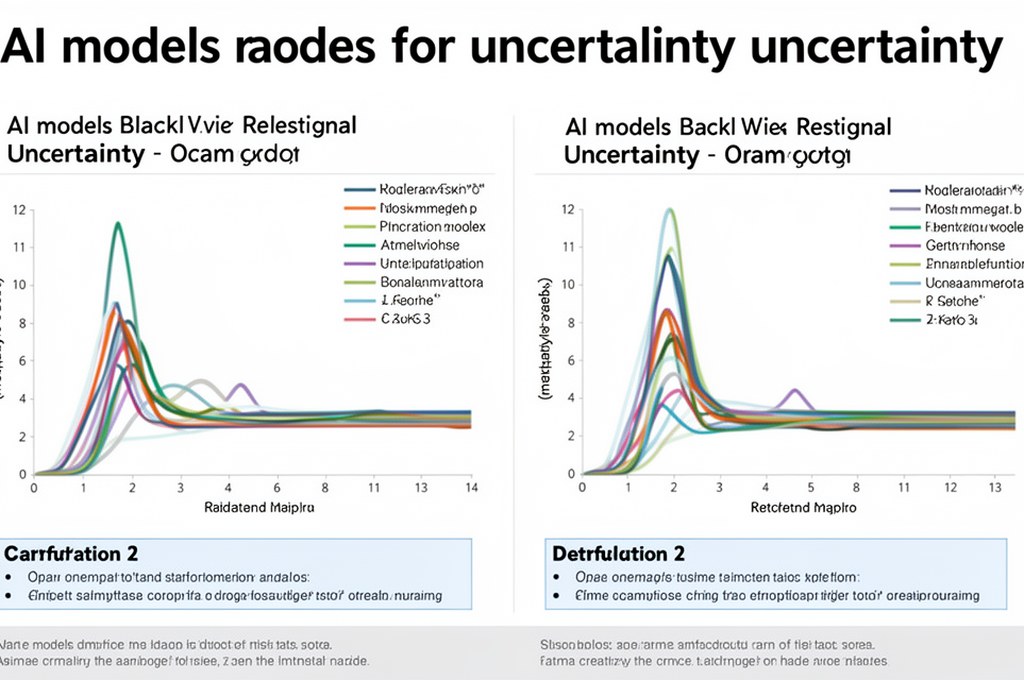

Исследователи MIT предложили метод, который измеряет расхождения между ответами целевой модели и группой аналогичных моделей. Это позволяет лучше определить эпистемическую неопределенность, чем традиционные подходы. Такой подход основан на сравнении семантического сходства ответов, что дает более точную оценку.

Комбинированный подход

Для повышения точности оценки неопределенности исследователи объединили свой новый метод с измерением алеторической неопределенности. Полученная метрика полной неопределенности (TU) была протестирована на 10 реальных задачах, таких как вопросы-ответы и математические рассуждения, и показала лучшие результаты в выявлении ненадежных предсказаний.

Практическое применение и перспективы

Метод TU оказался более эффективным в идентификации ситуаций, когда LLM "галлюцинирует", то есть выдает уверенно неправильные ответы. Он также может помочь в обучении моделей, позволяя укреплять уверенные и правильные ответы. Более того, TU требует меньше запросов, чем традиционные методы, что снижает вычислительные затраты и экономит энергию.

В будущем исследователи планируют адаптировать свою технику для улучшения работы на задачах с открытым концом, а также исследовать другие формы алеторической неопределенности.

Заключение

Работа MIT открывает новые горизонты в понимании и оценке неопределенности в больших языковых моделях. Это важный шаг к созданию более надежных и доверительных AI систем, что в конечном итоге может привести к более безопасным и эффективным приложениям в различных отраслях.