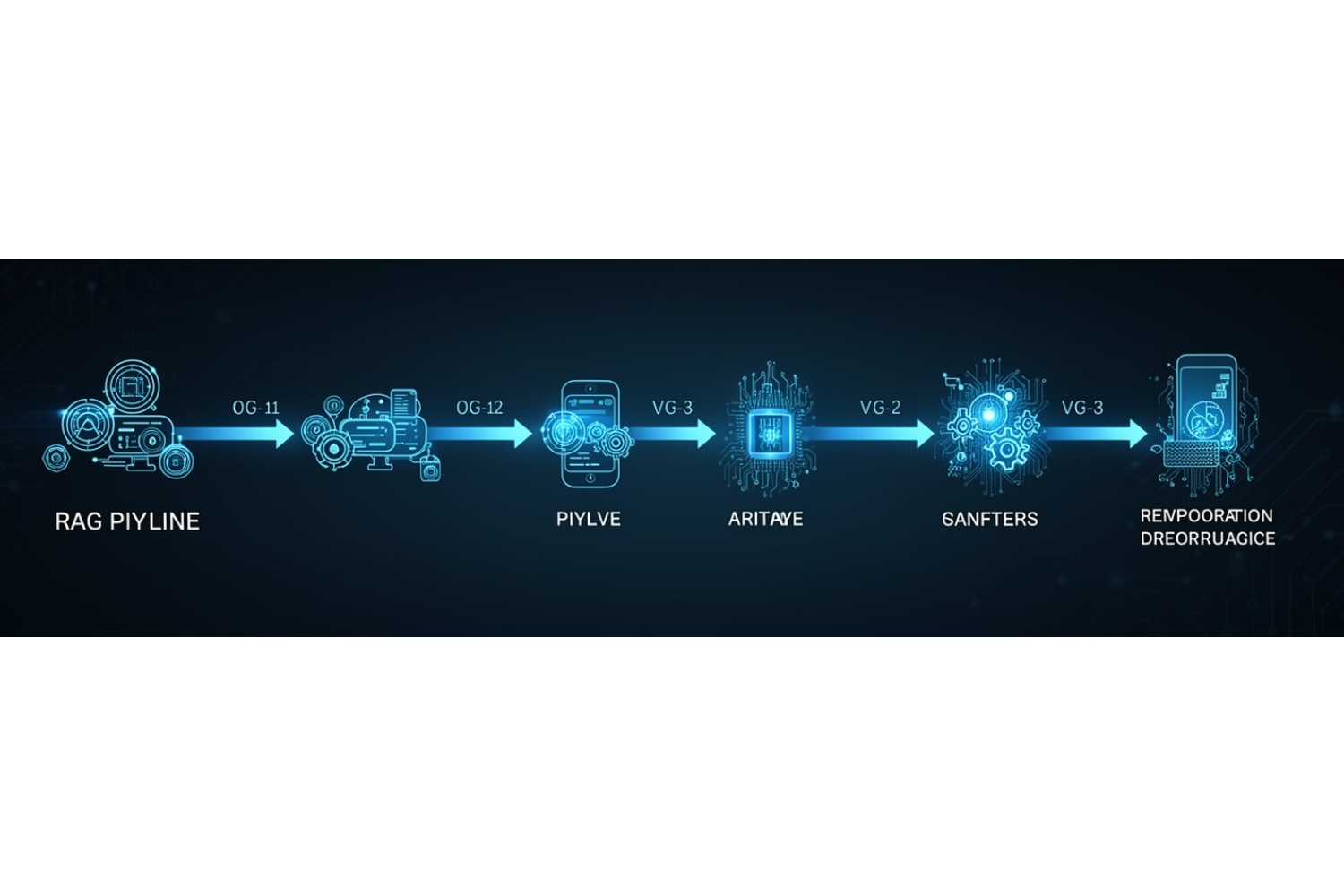

Введение в кэширование в RAG-пайплайнах

В последнее время Prompt Caching стал популярным методом оптимизации работы с большими языковыми моделями (LLM), поскольку позволяет существенно экономить ресурсы. Однако потенциал кэширования выходит далеко за пределы простого сохранения промптов. В данной статье мы рассмотрим, какие еще компоненты RAG-пайплайнов могут быть кэшированы для оптимизации работы AI систем.

Зачем кэшировать больше, чем промпты?

Prompt Caching оправдано, поскольку системные промпты и инструкции передаются в LLM в неизменном виде. Однако запросы пользователей также могут повторяться или быть похожими. В корпоративной среде многие запросы являются семантически схожими, например, "Сколько дней отпуска положено сотруднику согласно политике компании?" или "Как подать отчет о командировочных расходах?". Это делает актуальным использование семантического кэширования, помимо обычного.

Семантическое кэширование позволяет сохранять текстовые векторы, которые используются для поиска семантически схожих текстов. Например, для этого можно использовать векторные базы данных, такие как ChromaDB.

Типы кэширования

- Точное кэширование: сохраняет оригинальный текст или его нормализованную версию и используется только при точном совпадении.

- Семантическое кэширование: создает векторное представление текста и используется, если текст семантически схож с сохраненным.

Элементы RAG-пайплайна, которые можно кэшировать

Кэширование векторных представлений запросов

Первым шагом в RAG-системе является преобразование запроса в векторное представление для семантического поиска. Повторное вычисление векторов для одинаковых запросов может быть расточительным, особенно при высоких нагрузках. Вместо этого стоит использовать кэширование векторных представлений запросов.

Кэширование результатов извлечения

Можно также кэшировать результаты извлечения для определённого запроса. Это позволяет уменьшить необходимость выполнения полного извлечения для схожих запросов. Ключом в кэше может быть как оригинальный, так и нормализованный запрос, или его векторное представление.

Кэширование результатов ранжирования

Результаты работы модели переранжирования можно также кэшировать. Это позволяет получить переранжированные результаты сразу из кэша, без необходимости заново запускать модель. Ключом в кэше является комбинация запроса и извлеченных фрагментов.

Кэширование сборки промпта

После извлечения и ранжирования, соответствующие фрагменты комбинируются с системным промптом и запросом пользователя для формирования окончательного промпта. Если все элементы совпадают, мы можем использовать кэш, чтобы не собирать промпт заново.

Кэширование пар "запрос-ответ"

Наиболее интуитивным способом кэширования является сохранение пар "запрос-ответ". Это особенно полезно для часто повторяющихся запросов, позволяя избежать повторной обработки уже известных ответов.

Заключение

Эффективное кэширование в RAG-пайплайнах позволяет существенно снизить затраты и ускорить обработку запросов. Применение различных стратегий кэширования помогает оптимизировать работу AI-систем и улучшает их производительность.