Введение в проблему объяснимости ИИ

В условиях, где от решений искусственного интеллекта зависят жизни людей, например, в здравоохранении или автономном управлении транспортом, крайне важно понимать, как и почему модель пришла к тому или иному выводу. В этой статье мы рассмотрим новую методику, разработанную учеными MIT, которая позволяет моделям компьютерного зрения объяснять свои предсказания на человеческом языке.

Что такое модели концептуального узла?

Модели концептуального узла (concept bottleneck models, CBM) представляют собой подход, который помогает улучшить объяснимость ИИ. Они добавляют промежуточный этап, на котором модель прогнозирует концепции, присутствующие в изображении, а затем использует эти концепции для окончательного предсказания. Это позволяет пользователям понять, как модель приходит к своим выводам.

Однако предопределенные концепции могут не подходить для конкретной задачи, что снижает точность модели. Кроме того, модели могут использовать нежелательные данные, что известно как утечка информации.

Новый подход от MIT

Исследователи MIT предложили инновационный подход, который позволяет моделям использовать концепции, которые они уже усвоили во время обучения для выполнения конкретной задачи. В результате модель может не только предлагать более точные предсказания, но и давать более понятные объяснения.

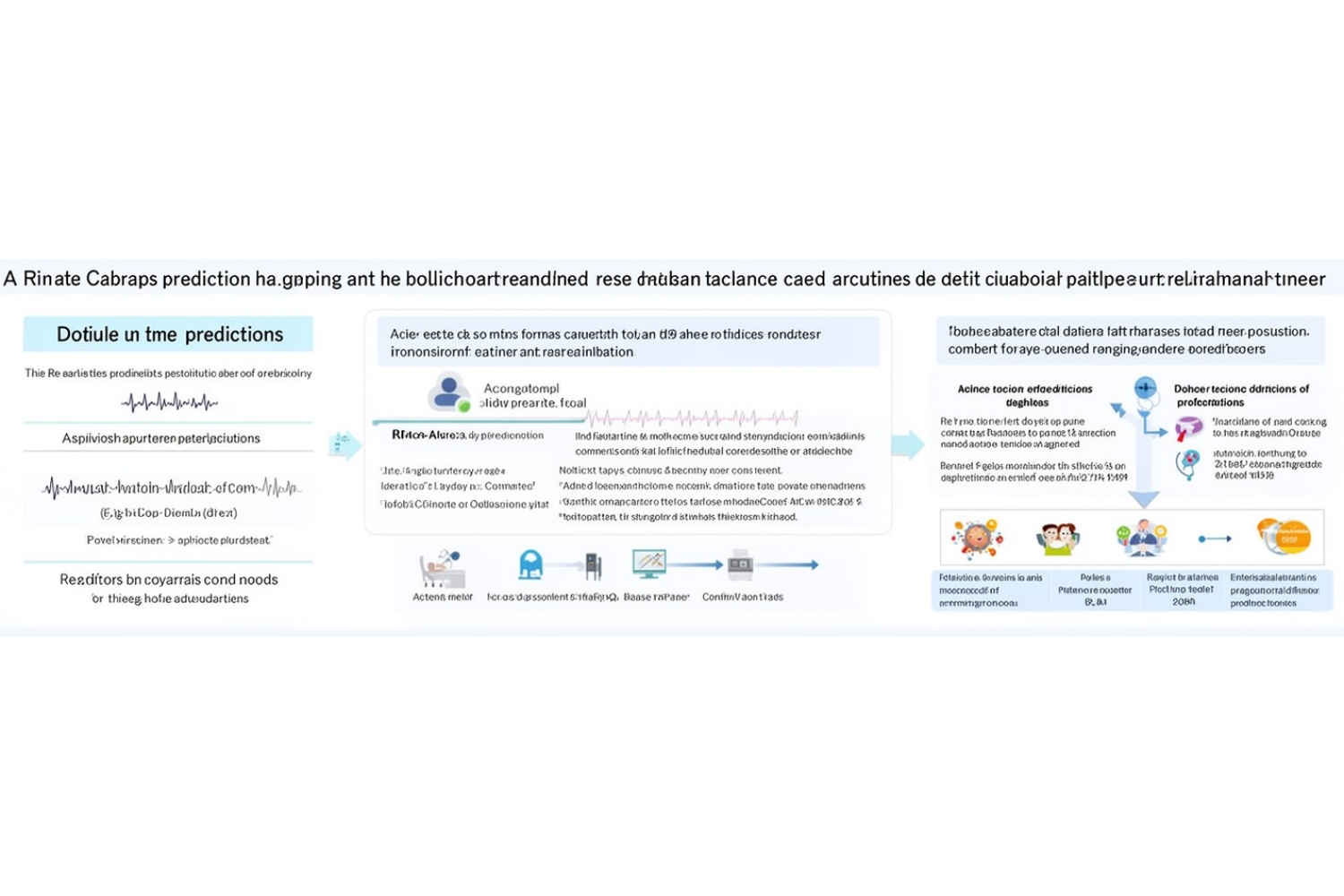

Как работает методика?

Основой методики является использование специализированной глубокой обучающей модели, называемой разреженным автоэнкодером. Она выделяет наиболее релевантные особенности, которые модель усвоила, и преобразует их в понятные концепции. Затем мультимодальная языковая модель (LLM) описывает каждую концепцию на простом языке и аннотирует изображения в наборе данных, определяя, какие концепции присутствуют или отсутствуют.

Преимущества и вызовы

Среди главных преимуществ нового подхода — его способность генерировать концепции, которые более точно соответствуют изображениям в наборе данных. Однако есть и вызовы, такие как необходимость обеспечения корректности аннотаций LLM и определение, действительно ли разреженный автоэнкодер выделил понятные человеку концепции.

Чтобы предотвратить использование неизвестных или нежелательных концепций, методика ограничивает модель в использовании всего пяти концепций для каждого предсказания. Это обеспечивает более понятные объяснения и помогает модели выбирать наиболее релевантные концепции.

Перспективы и будущее развитие

Хотя новый подход демонстрирует высокую точность и объяснимость, все же остается вопрос о необходимости балансирования между интерпретируемостью и точностью. В будущем исследователи планируют изучить решения проблемы утечки информации и масштабировать методику с использованием более крупных языковых моделей для аннотирования большего набора данных.

Эта работа открывает множество возможностей для дальнейших исследований и может стать мостом к символическому ИИ и графам знаний, как отмечает профессор Андреас Хотхо.