Введение в проблему галлюцинаций в LLM

Языковые модели большого размера (LLM, Large Language Models) стали неотъемлемой частью современных технологий, но их галлюцинации — это не просто ошибка данных или обучения. Эти случаи представляют собой структурную особенность того, как оптимизированы эти системы. Для лучшего понимания этого явления нам необходимо заглянуть внутрь модели и рассмотреть, что происходит, когда система выдает уверенный, но неправильный ответ.

Что происходит внутри модели: анализ траекторий

Траектория остаточного потока

Внутреннее состояние модели на каждом слое можно представить как точку в многомерном пространстве. Анализируя, как эта точка перемещается в процессе обработки запроса, мы можем визуализировать траекторию модели. Эксперимент показал, что при выдаче правильного и неправильного ответа траектории имеют одинаковую длину, но различаются по направлению.

Представьте себе два путешественника, которые начинают путь из одного и того же места, проходят одинаковую дистанцию, но приходят к разным местам назначения. Это и демонстрирует работа модели: она знает правильный ответ, но выбирает иной путь.

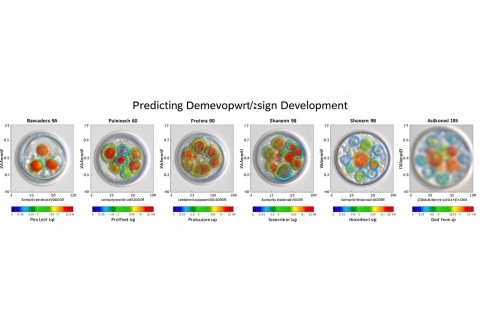

Коэффициент приверженности: анализ подавления

Представленный в исследовании коэффициент приверженности (κ) показывает, насколько модель направляет вероятность к правильному токену на каждом слое. В корректной обработке κ монотонно возрастает, а при галлюцинациях κ резко падает, что свидетельствует о сознательном отклонении от правильного ответа.

Архитектурные особенности и их влияние

Три режима поведения

Интересно, что модели с различным количеством параметров демонстрируют три разных режима подавления:

- Модели с 1B параметрами показывают начальные признаки перераспределения внимания, но подавление неполное.

- Модели с 1.6B–3B параметрами демонстрируют промежуточное подавление.

- Модель Gemma 2 2B, несмотря на меньший масштаб, достигает глубины подавления аналогичной более крупным моделям.

Обнаружение галлюцинаций и пути решения

Геометрическая сигнатура как инструмент обнаружения

Геометрическая сигнатура модели позволяет создать детекторы галлюцинаций, которые могут идентифицировать события подавления до достижения результата. Однако такие детекторы должны быть адаптированы для каждой доменной области, так как универсальный подход не подходит.

Что геометрия не решает

Механизм подавления, описанный в работе, не является багом, который можно исправить. Это следствие целевой функции обучения LLM, которая отдает предпочтение предсказанию следующего токена, а не фактической точности.

Заключение: почему это важно

Глубокое понимание внутренней работы LLM необходимо для создания более совершенных моделей. Данное исследование четко показывает, что геометрия обработки фактической информации в LLM отклоняется не по величине, а по направлению, и что это отклонение является активным, а не пассивным процессом.