Введение

Сегодня развитие технологий искусственного интеллекта, особенно языковых моделей, вызывает множество вопросов и дискуссий. Одним из таких вопросов является: почему ИИ кажется разумным, и в чем состоит иллюзия этого восприятия? Мы рассмотрим, как именно обучаются большие языковые модели (LLM), и почему их способности не следует путать с человеческой когнитивной активностью.

Предобучение: основа языковых моделей

Основной этап обучения LLM — это предобучение, в ходе которого модель учится предсказывать следующее слово в последовательности. Для этого используются огромные объемы текстовых данных, но смысл, намерение или коммуникация не являются целью модели.

Ключевые аспекты предобучения:

- Модели работают с токенами — числовыми представлениями слов, а не с самими словами.

- Задача модели заключается в минимизации ошибки предсказания токенов.

- Масштаб данных: LLM обучаются на триллионах токенов, что существенно превосходит объемы данных, доступные человеку за всю жизнь.

Сравнение с человеческим восприятием языка

Хотя люди также предсказывают следующее слово в процессе чтения или восприятия речи, для них это вторичный эффект от понимания. Когда человек читает рассказ, он строит ментальную модель событий, отслеживая персонажей, их намерения, эмоции и последствия действий. Для LLM предсказание — это конечная цель, а не побочный продукт понимания.

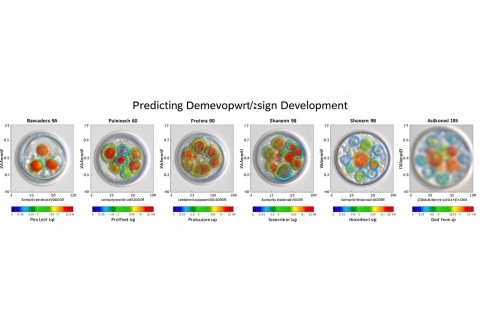

Тонкая настройка и обучение с подкреплением

После предобучения модели проходят этапы тонкой настройки и обучения с подкреплением, что позволяет им выполнять более сложные задачи, такие как ответы на вопросы и соблюдение социальных норм.

Основные методы:

- Тонкая настройка: люди предоставляют примеры желаемого поведения, ранжируют ответы и поощряют ясность и полезность.

- Обучение с подкреплением: модели оптимизируются для генерации ответов, которые предпочитают люди, но это не дает модели новых знаний о мире или личного опыта.

Этот процесс делает модели более "человечными", но их обучение все равно остается статистическим, основанным на предпочтениях людей, а не на собственном опыте моделей.

Почему ИИ кажется "мыслящим"?

Когда LLM демонстрируют способность к рассуждению, это обусловлено не истинным пониманием, а способностью имитировать языковые паттерны. Модели видели множество примеров текстов, содержащих рассуждения, математические шаги, аргументы и доказательства.

Таким образом, когда модель "думает", она генерирует последовательности, похожие на рассуждения, потому что это повышает вероятность получения правильного ответа в данном контексте. Однако модель не знает, какие шаги необходимы или достаточны для решения задачи.

Заключение

Хотя языковые модели могут производить впечатление разумных, их способности к пониманию и обучению значительно отличаются от человеческих. Они основаны на предсказании и статистической обработке данных, а не на когнитивных процессах, характерных для людей. Понимание этих различий помогает лучше оценивать текущие достижения и ограничения искусственного интеллекта.