Введение: важность объяснимости в ИИ

В условиях, где решения, основанные на прогнозах искусственного интеллекта, могут иметь критически важные последствия, такие как медицина или автономные транспортные средства, пользователи должны доверять этим моделям. Однако доверие невозможно без понимания того, как и почему модель пришла к определенному выводу. В этом контексте ключевую роль играет объяснимость моделей ИИ.

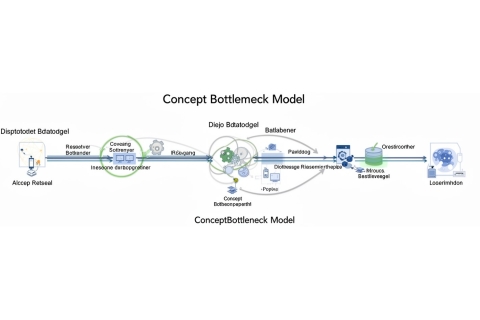

Концепция узких мест: подход к объяснимости

Один из методов, который позволяет моделям ИИ объяснять процесс принятия решений, называется моделированием узких мест концепции (Concept Bottleneck Modeling, CBM). Этот метод вынуждает модель использовать набор понятий, которые могут быть поняты человеком, для формирования прогноза.

Например, для предсказания наличия меланомы в медицинском изображении могут использоваться концепции, такие как "скопления коричневых точек" или "разнообразная пигментация". Однако ранее определенные концепции могут оказаться недостаточно релевантными для конкретной задачи, что снижает точность модели.

Новый подход от MIT: улучшение объяснимости и точности

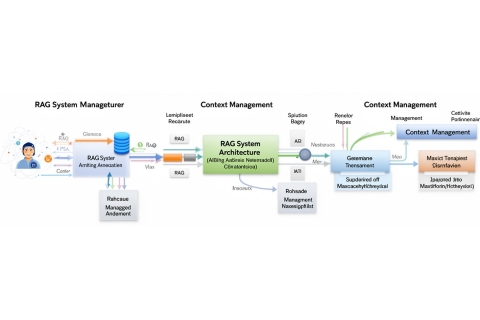

Исследователи из MIT предложили метод, который извлекает концепции, уже изученные моделью во время обучения, и использует их для объяснения прогнозов. Этот подход предлагает более понятные объяснения по сравнению с традиционными моделями узких мест концепции.

Метод включает использование пары специализированных моделей машинного обучения, которые автоматически извлекают знания из целевой модели и переводят их в понятные человеку концепции. Это позволяет преобразовать любую предварительно обученную модель компьютерного зрения в модель, способную объяснить свои решения через концепции.

Преимущества и вызовы нового подхода

Новшество в том, что подход MIT позволяет извлекать концепции, которые модель уже изучила, что улучшает как точность, так и объяснимость. Однако остаются проблемы, такие как утечка информации, когда модель использует нежелательные концепции, и необходимость в улучшении интерпретируемости без потери точности.

Будущее объяснимого ИИ

Исследования MIT представляют собой шаг вперед к созданию более объяснимых моделей ИИ, которые могут быть безопасно внедрены в критически важных областях. В будущем планируется улучшение методов борьбы с утечкой информации и масштабирование подхода для работы с большими данными.

Такие усилия открывают множество возможностей для интеграции объяснимого ИИ с символическим ИИ и графами знаний, что может привести к более глубокому пониманию и доверительным отношениям между человеком и машиной.