Появление AI-кодировщиков, таких как Cursor, Claude Code, Windsurf и Cortex Code, существенно изменило подходы к разработке программного обеспечения. Однако, несмотря на их мощность, они страдают от одного серьезного недостатка — отсутствия памяти. Каждый новый сеанс взаимодействия с AI начинается с чистого листа, что требует от пользователей повторения одних и тех же инструкций и контекстов. В этой статье мы рассмотрим, почему память важна для AI-кодировщиков и как ее внедрение может изменить индустрию.

Проблема отсутствия памяти в AI-кодировщиках

Большие языковые модели (LLM) не запоминают предыдущие взаимодействия. Этот подход обусловлен архитектурными решениями и вопросами конфиденциальности. Каждая беседа начинается с нуля, и вся информация исчезает после закрытия чата. Это создает трение для пользователей, которым требуется непрерывность в работе.

Без долговременной памяти пользователи вынуждены становиться «слоем памяти», вручную копируя и вставляя контекст, повторно объясняя правила и отвечая на одни и те же вопросы снова и снова. Это, очевидно, не масштабируется.

Краткосрочная и долговременная память

Технически память AI можно разделить на два типа:

- Краткосрочная память: Это информация, которую AI запоминает в рамках одного сеанса. Она включает текущую беседу, открытые файлы и недавние действия. После закрытия чата вся эта информация исчезает.

- Долговременная память: Это информация, сохраняющаяся между сеансами. Она обеспечивается файлами правил, сервисами памяти и внешними интеграциями.

Стоимость повторения

Отсутствие долговременной памяти имеет свою цену. Рассмотрим примеры:

Без постоянного контекста:

- Вы: Построй мне дашборд для этих данных

- AI: Вот React-дашборд с Chart.js…

- Вы: Нет, я использую Streamlit

- AI: Вот приложение Streamlit с Plotly…

- Вы: Я предпочитаю Altair для графиков

- AI: Вот версия с Altair…

- Вы: Можешь использовать широкий макет?

- AI: [наконец-то создает что-то пригодное после 4 исправлений]

С постоянным контекстом (файл правил):

- Вы: Построй мне дашборд для этих данных

- AI: [читает ваш файл правил, знает ваш стек и предпочтения] Вот дашборд Streamlit с широким макетом и графиками Altair…

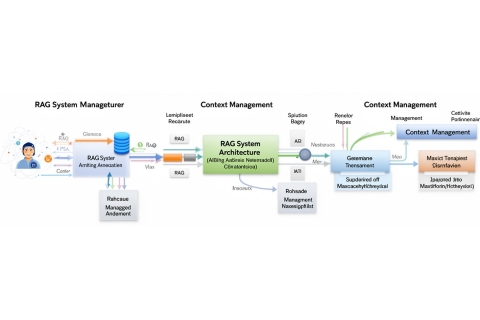

Контекстная инженерия как недостающий слой

Для решения проблемы отсутствия памяти была разработана концепция контекстной инженерии. Это систематическая сборка информации, необходимой AI для выполнения задач с высокой надежностью.

Контекстная инженерия напоминает процесс введения нового сотрудника в проект. Вместо того, чтобы просто назначить задачу и надеяться на лучшее, вы предоставляете коллеге всю необходимую информацию о проекте, доступ к необходимым инструментам и четкие инструкции. Системы памяти делают то же самое для AI-кодировщиков.

Уровни контекстной инженерии

- Файлы правил проекта: Markdown-файлы, которые AI может автоматически читать в начале каждого сеанса.

- Глобальные правила: Настройки, которые следуют за вами между проектами. Они могут быть концептуальными и касаться стиля общения и качества кода.

- Системы имплицитной памяти: Инструменты, такие как Pieces, которые автоматически захватывают и сохраняют информацию о вашей работе.

- Кастомная инфраструктура памяти: Решения для команд с особыми потребностями, такие как Mem0 или Pinecone, которые предоставляют APIs для управления памятью.

Перспективы и будущее памяти в AI-кодировщиках

Память становится важным аспектом AI-инструментов разработки. Протоколы, такие как Model Context Protocol (MCP), набирают популярность. Инструменты имплицитной памяти совершенствуются, и каждый крупный AI-кодировщик добавляет поддержку постоянного контекста.

В будущем AI-кодировщики будут становиться все более умными и контекстно-осведомленными, благодаря интеграции памяти. Такие инновации позволят разработчикам сосредотачиваться на создании креативных решений, минимизируя время на рутинные задачи.