Введение в проблему объясняемости AI

В условиях, где ставки высоки, таких как медицинская диагностика и автономное вождение, пользователям важно понимать, как и почему модель искусственного интеллекта пришла к тому или иному выводу. Это позволяет определить, можно ли доверять полученным результатам. Один из методов, позволяющих системам AI объяснять свои решения, — это моделирование концептуальных узких мест (Concept Bottleneck Modeling). Этот подход заставляет модели использовать набор понятий, которые легко интерпретировать человеку, для составления прогнозов.

Новая методика от MIT

Исследователи из MIT разработали метод, который улучшает точность и ясность объяснений, генерируемых моделями. Вместо использования заранее заданных понятий, которые могут быть неактуальны или недостаточно детализированы, новый подход извлекает концепции, которые модель уже усвоила при обучении, и использует их для объяснения своих решений. Это позволяет добиться более точных и понятных объяснений.

Применение в различных областях

Для иллюстрации, в медицинской сфере специалист может предложить использовать такие понятия, как "скопление коричневых точек" и "разнообразная пигментация", чтобы предсказать наличие меланомы на медицинском изображении. Аналогично, модель, которая идентифицирует виды птиц, может использовать понятия "желтые лапки" и "синие крылья" для определения ласточки.

Как работает новая система

Новая система использует пару специализированных моделей машинного обучения, которые автоматически извлекают знания из целевой модели и переводят их на понятный язык. В результате, любая предварительно обученная модель компьютерного зрения может быть преобразована в модель, объясняющую свои решения через концепции.

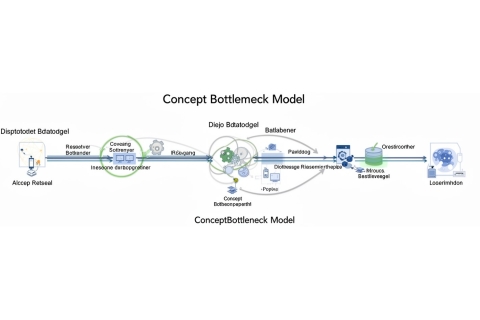

Этапы работы метода

Первый этап включает использование специализированной модели глубокого обучения, называемой редким автокодировщиком, которая выбирает наиболее релевантные свойства, усвоенные моделью, и реконструирует их в набор концепций. Далее мульти-модальная языковая модель (LLM) описывает каждую концепцию на простом языке и аннотирует изображения в датасете, определяя, какие концепции присутствуют в каждом изображении.

Эти аннотированные данные используются для обучения модуля концептуального узкого места, который интегрируется в целевую модель, заставляя её делать предсказания, опираясь только на извлеченные концепции.

Контроль и ограничение использования понятий

Чтобы предотвратить использование неизвестных или нежелательных концепций, модель ограничена использованием всего пяти понятий для каждого прогноза. Это также способствует выбору наиболее релевантных понятий и упрощает объяснения.

Сравнивая с современными моделями концептуальных узких мест, исследователи обнаружили, что их метод обеспечивает более высокую точность и более точные объяснения. Он также создаёт концепции, которые больше соответствуют изображениям в наборе данных.

Перспективы и важность исследования

Эта работа открывает новые возможности для разработки более объяснимых AI систем, создавая мост к символическому AI и графам знаний. Она показывает, что извлечение концепций из внутренних механизмов модели может привести к более достоверным объяснениям.

В будущем исследователи планируют изучать решения проблемы утечки информации и расширять метод, используя более крупные мультимодальные LLM для аннотирования большего количества обучающих данных, что может повысить производительность моделей.